Après les modèles spécialisés, place à la machine agentique. Mistral empile Medium 3.5, agents Vibe distants et Work mode pour pousser Le Chat au-delà de la conversation, vers une IA capable de coder, orchestrer et agir sous contrôle humain.

Vu de loin, ce début d’année 2026 ressemble pour Mistral à une longue mise en place méthodique. En mars, la pépite parisienne dévoilait Mistral Small 4, son premier modèle « merged » sous Apache 2.0 : un MoE 119B (6B actifs) qui fusionnait pour la première fois Magistral (raisonnement), Pixtral (multimodal) et Devstral (coding) dans un seul jeu de poids, avec un effort de raisonnement réglable par requête. Il marquait une rupture stratégique : finie la galaxie de modèles spécialisés, place à un socle unique et configurable.

Quelques semaines plus tard, l’équipe complétait le tableau côté entreprise avec Workflows, une couche d’orchestration durable bâtie sur le moteur Temporal qui apporte aux pipelines IA en production l’observabilité, la reprise sur incident et le human-in-the-loop qui leur faisaient cruellement défaut.

Avec la salve d’aujourd’hui – Medium 3.5, agents Vibe distants et Work mode dans Le Chat – Mistral assemble un peu plus ses pièces à l’heure de l’IA agentique.

L’effet d’ensemble

La startup française n’a clairement pas l’intention de laisser les américains (OpenAI, Anthropic, AWS, Google, Microsoft, IBM, Salesforce, ServiceNow) occuper seuls la conversation sur les agents. Avec une triple annonce coordonnée – un nouveau modèle phare, des agents codeurs distants et un mode « travail » pour Le Chat – Mistral veut démontrer sa capacité à aligner une pile cohérente, du modèle de base à l’expérience utilisateur, en passant par l’orchestration agentique. Le tout joliment résumé par la formule d’ouverture du communiqué : « Les agents de coding vivaient jusqu’ici sur votre portable. Aujourd’hui, on les déplace dans le cloud. »

Mistral Medium 3.5, le couteau suisse à 128 milliards de paramètres

Au cœur du dispositif, Mistral Medium 3.5 est ce que la maison appelle son premier « merged model » maison en version « flagship ». Comprendre : un modèle dense unique de 128 milliards de paramètres, doté d’une fenêtre de contexte de 256 000 tokens, qui fusionne dans un seul jeu de poids le suivi d’instructions, le raisonnement et le code. Là où Small 4 avait validé l’approche en MoE, Medium 3.5 la décline en architecture dense, plus prévisible côté inférence pour les workloads agentiques longs. L’effort de raisonnement reste réglable par requête : le même modèle peut donc expédier une réponse rapide ou se lancer dans un run agentique long format.

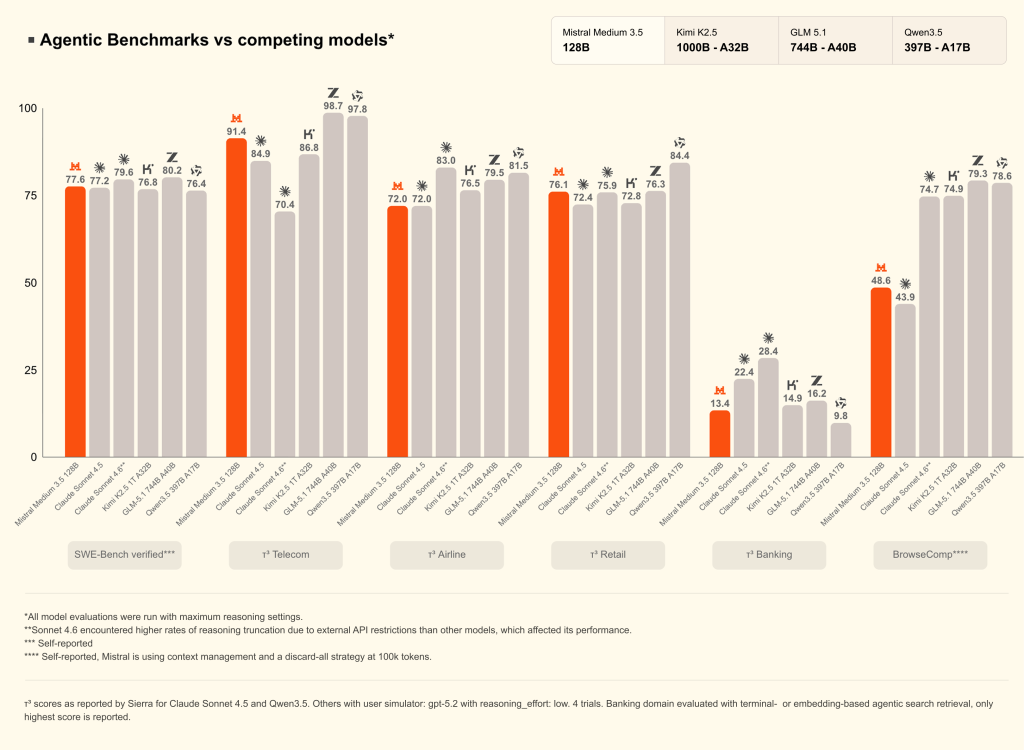

Côté benchmarks, la copie est solide : 77,6 % sur SWE-Bench Verified (devant Devstral 2 et surtout devant le Qwen3.5 397B A17B d’Alibaba) et 91,4 sur τ³-Telecom pour les capacités agentiques. L’encodeur visuel a, lui, été ré-entraîné depuis zéro pour gérer des images aux tailles et ratios variables.

Bien évidemment, c’est l’ADN de Mistral, le modèle est publié en open weights sous une licence MIT modifiée,. Il est d’ores et déjà disponible sur Hugging Face.

Mistral revendique également un self-hosting praticable « sur seulement quatre GPU ». Pour les DSI échaudés par les coûts d’inférence et les enjeux de souveraineté, la promesse est séduisante et confirme la volonté de Mistral d’aider les entreprises à construire leurs projets IA en toute autonomie.

Côté tarification API sur « La Plateforme », il faut compter 1,50 $ par million de tokens en entrée, 7,50 $ en sortie. Le modèle est également hébergé sur build.nvidia.com et déployable en microservice via NVIDIA NIM.

Medium 3.5 devient au passage le modèle par défaut dans Le Chat et remplace Devstral 2 dans sa solution Vibe CLI.

Vibe : le coding agent quitte le terminal pour le cloud

Autre annonce. Avec Vibe remote agents, les sessions de coding peuvent désormais tourner en parallèle dans des sandbox isolées, déclenchées depuis le CLI ou directement depuis Le Chat. Le développeur lance, ferme l’onglet, va prendre un café et l’agent travaille, ouvre une pull request sur GitHub à l’arrivée, et notifie quand c’est prêt. « Vous cessez d’être le goulot d’étranglement à chaque étape de l’agent » explique l’éditeur, un peu provocateur.

Dit autrement, les Vibe remote agents sont des agents IA de développement capables de prendre en charge une tâche de code à distance, dans le cloud, plutôt que de se limiter à suggérer des lignes dans l’éditeur du développeur. On leur confie un ticket — corriger un bug, ajouter des tests, moderniser un module, analyser un échec de CI/CD — et ils travaillent dans un environnement isolé, modifient les fichiers, exécutent des commandes, documentent leur progression et peuvent préparer une branche ou une pull request à relire. L’idée est de passer d’un copilote qui assiste le développeur en temps réel à un assistant autonome mais supervisé, capable de travailler en parallèle sur des tâches bien cadrées, avec validation humaine obligatoire avant intégration.

Refactorings modulaires, génération de tests, mises à jour de dépendances, investigations CI, correctifs de bugs… Bref, tout ce « travail bien défini qui prend le temps du développeur sans solliciter son jugement » se retrouve agentifié et réalisé par l’IA.

Vibe se branche sur GitHub pour le code et les PR, Linear et Jira pour les tickets, Sentry pour les incidents, Slack et Teams pour le reporting. Cerise sur le gâteau : une session locale en cours peut être « téléportée » dans le cloud, avec son historique, son état et ses approbations conservés.

Sous le capot, Mistral réutilise directement sa technologie « Workflows » (orchestrée dans Mistral Studio), la couche dévoilée la semaine dernière et déjà rodée chez les grands comptes européens. Une capacité d’abord développée en interne, puis déployée chez les clients entreprise, et désormais ouverte à tous via Vibe.

Work mode : Le Chat passe en mode exécution

Troisième annonce et troisième brique stratégique : l’arrivée (en preview) d’un Work mode dans Le Chat, son assistant conversationnel.

Le principe est simple : Le Chat ne se contente plus de répondre, il agit. Concrètement, l’assistant peut désormais enchaîner plusieurs étapes pour mener une tâche complexe à son terme, en piochant dans vos outils connectés. Quelques exemples concrets : trier votre boîte mail et préparer des brouillons de réponses, créer automatiquement des tickets Jira à partir d’échanges clients, ou préparer une réunion en agrégeant le profil des participants, l’actualité récente et les points clés issus de vos documents internes, le tout livré sous forme de brief structuré, prêt à être édité et envoyé.

Différence notable avec le mode chat classique : tous les connecteurs (mail, agenda, documents, outils métier) sont activés par défaut, ce qui permet à l’agent d’aller chercher lui-même le contexte dont il a besoin. La transparence reste de mise : chaque action déclenchée et chaque appel d’outil sont visibles en direct dans la conversation. Et avant toute opération sensible — envoyer un message, modifier un document, créer un ticket — Le Chat demande systématiquement votre validation explicite.

Mistral colmate ici une faiblesse qui devenait gênante face à Claude Code, Codex ou GitHub Copilot : l’absence d’agents asynchrones distants. En unifiant son flagship sur un seul modèle dense, en publiant les poids, et en intégrant verticalement Studio + Workflows + Vibe + Le Chat, la maison française se dote d’une vraie stack agentique à même de séduire un DSI européen sensible aux questions de souveraineté. Reste à voir comment Medium 3.5 tient en production face aux Opus 4.7 et autres GPT-5.5. Mais sur le papier, le rapport prix/performance/ouverture est l’un des plus attrayants du marché.

Medium 3.5 et Work Mode sont disponibles dès aujourd’hui dans Le Chat sur les plans Pro, Team et Enterprise.

____________________________

puis

puis