NetApp a choisi de surfer sur l’attention médiatique de la GTC de NVIDIA pour faire deux annonces majeures où l’IA joue un rôle central : une plateforme de données IA qui va fouiller intelligemment dans vos pétaoctets, et deux nouvelles baies all-flash qui pulvérisent de 250 % les performances de la génération précédente.

Les données sont partout, dans des silos, des formats divers, des datacenters éclatés entre le on-prem et le cloud. Construire un pipeline IA robuste là-dessus, est un exercice complexe qui revient un peu à jongler les yeux bandés.

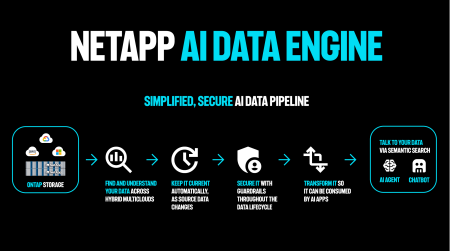

C’est précisément le défi que NetApp compte aider à relever avec sa nouvelle plateforme AIDE (NetApp AI Data Engine), qui avait déjà été dévoilée en octobre dernier mais qui fait réellement ses premiers pas auprès de partenaires privilégiés à l’occasion de la GTC NVIDIA 2026 à San Jose. Le groupe renouvelle également sa gamme EF-Series avec les EF50 et EF80, deux baies all-flash pensées pour les charges où la performance brute reste décisive, de l’IA au HPC en passant par les bases de données transactionnelles.

Depuis longtemps, NetApp ne cherche plus simplement à vendre du stockage. Et aujourd’hui, la firme américaine veut devenir une couche de données incontournable pour les “AI factories”, en s’arrimant plus étroitement à l’écosystème NVIDIA. AIDE rend les données plus exploitables par les modèles, pendant que les EF50 et EF80 alimentent les charges les plus gourmandes en débit et en latence.

AIDE : le catalogue de métadonnées qui comprend ce qu’il lit

AIDE n’est pas un énième outil de data management. L’éditeur cherche ici moins à vendre du stockage qu’à se rendre incontournable comme couche de données gouvernée pour les AI factories. Co-conçu avec NVIDIA, cette plateforme s’intègre nativement au design de référence NVIDIA AI Data Platform et repose sur un principe malin : plutôt que de déplacer les données pour les préparer à l’IA, AIDE va les analyser sur place. Le système crée et met à jour en continu un catalogue global de métadonnées qui ne se contente pas des attributs classiques (nom, taille, date). Il plonge dans le contenu des fichiers pour en extraire un enrichissement sémantique. Autrement dit, il comprend de quoi parlent vos données, pas seulement où elles sont rangées. NetApp ne présente pas AIDE comme un simple catalogue “intelligent”, mais comme une brique plus large de préparation et de contrôle des données d’entreprise non structurées

L’intérêt est immédiat pour le pipeline IA : de la sélection des données d’entraînement à la phase de retrieval pour le RAG, en passant par la gouvernance et le service aux agents IA, AIDE garantit que le modèle travaille toujours sur les données les plus pertinentes et les plus fraîches. « Pour reprendre la maîtrise de leurs données, les organisations ont besoin d’une plateforme conçue dès l’origine pour être flexible et intelligente, permettant au stockage, aux services et à la gouvernance d’évoluer indépendamment » explique Syam Nair, Chief Product Officer de NetApp.

Côté feuille de route, AIDE sera accessible dès ce mois-ci pour une première vague de clients et partenaires, avec une disponibilité générale prévue cet été. Les prochaines étapes incluent le support multimodal (données visuelles), le support de l’IA agentique avec des workflows sécurisés et gouvernés, et des intégrations avec Google Cloud Vertex AI, LangChain, et les services Azure.

AIDE sera déployable sur les GPU NVIDIA RTX PRO 4500 et 6000 Blackwell Server Edition, et supportera l’ensemble du parc de stockage NetApp existant (AFF A-Series, AFF C-Series, FAS).

Détail qui compte pour l’avenir : NetApp prendra en charge NVIDIA STX, l’architecture de référence rack-scale pour l’IA agentique, bâtie sur les GPU Vera Rubin et les DPU BlueField-4, avec un tier mémoire spécialisé pour le stockage KV-Cache..

EF50 et EF80 : le retour musclé de la gamme Santricity

L’autre annonce, plus discrète mais tout aussi significative, concerne le renouvellement de la gamme EF-Series, ces baies all-flash qui tournent sous Santricity OS (pas ONTAP) et qu’on peut décrire comme du stockage NetApp déshabillé de tout superflu pour aller le plus vite possible.

Les chiffres parlent d’eux-mêmes. Là où les EF600 existants plafonnaient à 44 Go/s en lecture et 13 Go/s en écriture, les nouveaux EF50 et EF80 délivrent plus de 110 Go/s en lecture et 55 Go/s en écriture, le tout dans un format 2U offrant jusqu’à 1,5 Po de capacité. L’EF80 grimpe jusqu’à 5 millions d’IOPS. C’est une multiplication par 2,5 des débits, tout simplement. L’éditeur met aussi en avant un rendement énergétique de 63,7 Go/s par kW, un argument loin d’être secondaire à l’heure où les projets IA se heurtent autant aux limites électriques et thermiques des datacenters qu’aux budgets d’infrastructure.

Sandeep Singh, SVP et GM du stockage entreprise chez NetApp, ne s’en cache pas : « ces baies sont spécialement conçues pour des performances extrêmes », destinées à « déployer et adapter rapidement des charges de travail à haut débit et faible latence, tout en réduisant l’empreinte datacenter et la surcharge opérationnelle. »

La cible ? Le HPC, l’entraînement et l’inférence IA, les bases de données transactionnelles et, même, les clouds d’IA souverains. Couplés à des systèmes de fichiers parallèles comme Lustre ou BeeGFS, les EF50 et EF80 servent de scratch space ultra-rapide pour maintenir les GPU à pleine charge. L’EF80 vise les usages les plus extrêmes, en particulier l’IA et le HPC, tandis que l’EF50 cible davantage des environnements mixtes, par exemple les bases de données.

Au passage on apprend que NetApp revendique plus d’un million d’installations EF-Series dans le monde. Un nombre qui rappelle que la face immergée de l’iceberg NetApp est bien plus vaste qu’on ne le pense généralement.

En résumé, NetApp joue simultanément sur deux tableaux au GTC 2026. Avec AIDE, le constructeur se positionne sur le terrain de l’intelligence des données pour l’IA (enrichissement sémantique, gouvernance, IA agentique) en s’arrimant étroitement à l’écosystème NVIDIA. Avec les EF50/EF80, il rappelle qu’il sait aussi faire du stockage brut, rapide et dense, pour les workloads qui ne tolèrent aucun compromis sur la performance. Deux philosophies, une même ambition : devenir la couche de données indispensable de l’ère IA.

____________________________

puis

puis