Deux semaines après le lancement de GPT-5.4 Thinking, son modèle frontière haut de gamme, OpenAI complète sa gamme avec deux déclinaisons compactes et véloces : GPT-5.4 Mini et GPT-5.4 Nano. Objectif : offrir aux développeurs et aux entreprises des modèles taillés pour les flux massifs où la latence et le coût au token comptent autant, sinon plus, que la puissance brute de raisonnement.

Lancé le 5 mars 2026, GPT-5.4 Thinking s’est immédiatement imposé comme le modèle frontière le plus polyvalent d’OpenAI. Fenêtre de contexte pouvant grimper jusqu’à 1,05 million de tokens, capacité native de « Computer Use » pour piloter un bureau à distance, 33 % d’erreurs factuelles en moins par rapport à GPT-5.2, score record de 83 % au GDPval (un benchmark qui évalue les tâches de travail intellectuel dans 44 métiers)… Le modèle coche toutes les cases du haut de gamme et tient la dragée haute à Claude Opus 4.6 et Gemini Pro 3.1.

Le problème, c’est que cette puissance a un prix. À 2,50 $ par million de tokens en entrée et 15 $ en sortie (et le double au-delà de 272 000 tokens de contexte), GPT-5.4 Thinking reste un modèle conçu pour les usages à forte valeur ajoutée comme l’analyse juridique, la modélisation financière, le raisonnement multi-étapes complexe. Et ne parlons même pas de la version Pro, carrément tarifé 30 $/180 $ le million de tokens. Autant dire que faire tourner un chatbot de support client ou un pipeline de classification de données sur GPT-5.4, c’est un peu comme prendre un Airbus A380 pour aller chercher le pain.

Or, en ce début 2026, la réalité du marché impose davantage de souplesse, de diversité et de flexibilité tarifaire. Les entreprises ne cherchent plus seulement le modèle le plus intelligent, elles cherchent le modèle le plus rentable pour chacune des tâches IA envisagées. L’heure est à l’optimisation du coût au token, pas à la course aux benchmarks. Et c’est précisément là qu’interviennent GPT-5.4 Mini et Nano.

GPT-5.4 Mini : le bras droit rapide et presque aussi futé

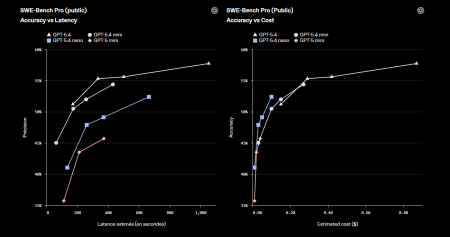

GPT-5.4 Mini est le modèle qui devrait faire le plus de bruit. Plus de deux fois plus rapide que GPT-5 Mini, il s’approche des performances du grand GPT-5.4 sur plusieurs benchmarks majeurs, tout en étant facturé 0,75 $ par million de tokens en entrée et 4,50 $ en sortie, soit trois fois moins que le modèle phare.

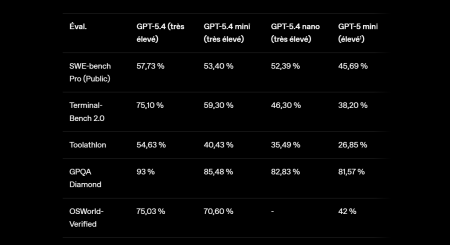

Les chiffres parlent d’eux-mêmes. Sur SWE-Bench Pro, le benchmark de référence en ingénierie logicielle, Mini atteint 54,4 % contre 57,7 % pour le GPT-5.4 complet, un écart de seulement 3,3 points. Sur OSWorld-Verified, qui évalue la capacité d’un modèle à manipuler un bureau en interprétant des captures d’écran, Mini affiche 72,1 %, quasiment au niveau du flagship (75 %) et au-dessus du seuil de performance humaine (72,4 %). Le tout avec un temps de réponse divisé par deux.

Le modèle prend en charge les entrées texte et image, l’appel de fonctions, la recherche web, la recherche dans les fichiers et le « Computer Use », le tout dans une fenêtre de contexte de 400 000 tokens. En clair : c’est un GPT-5.4 en version allégée, pas un GPT-5.4 amputé.

Abhisek Modi, responsable de l’ingénierie IA chez Notion, confirme l’intérêt du modèle : « GPT-5.4 Mini gère les tâches ciblées et bien définies avec une précision impressionnante. […] Jusqu’à récemment, seuls les modèles les plus coûteux pouvaient gérer de manière fiable l’appel d’outils agentiques. Aujourd’hui, des modèles plus petits comme GPT-5.4 Mini et Nano s’en chargent facilement ». Un constat partagé par Jerry Ma, Deputy CTO de Perplexity, qui salue un « raisonnement solide » côté Mini.

GPT-5.4 Mini est d’ores et déjà disponible dans ChatGPT (pour les utilisateurs Free et Go via la fonction « Thinking ») ainsi que via l’API d’OpenAI et dans Codex. Dans ce dernier, il ne consomme que 30 % du quota GPT-5.4, ce qui le rend économiquement viable pour les tâches de codage moins complexes et plus itératives.

GPT-5.4 Nano : le petit soldat des pipelines

Si Mini est le lieutenant polyvalent, Nano est le fantassin spécialisé dans les opérations de masse. C’est le modèle le plus petit et le moins cher de la gamme GPT-5.4, facturé à peine 0,20 $ par million de tokens en entrée et 1,25 $ en sortie, autrement moins cher que le Gemini 3.1 Flash-Lite de Google.

Nano n’a pas vocation à rivaliser avec Mini sur les tâches complexes. Son terrain de jeu : la classification, l’extraction de données structurées, le ranking, le tri et le routage, les vérifications de conformité et de sécurité, et les sous-tâches de codage légères. Autrement dit, tout ce qui relève du traitement répétitif à haut débit où chaque milliseconde et chaque centime comptent.

Sur SWE-Bench Pro, Nano atteint 52,4 %, un score supérieur à celui de l’ancien GPT-5 Mini (45,7 %). En revanche, sur OSWorld-Verified, il marque le pas à 39 % (contre 42 % pour GPT-5 Mini), ce qui confirme qu’il n’est pas fait pour naviguer dans des interfaces graphiques complexes. Chaque modèle à sa place.

Détail important mais finalement très logique, GPT-5.4 Nano est exclusivement disponible via l’API. Pas de ChatGPT, pas de Codex. OpenAI le positionne clairement comme un outil d’infrastructure pour développeurs, pas comme un produit grand public. Il faudra voir comment OpenAI l’utilise et le promotionne sur Frontier et sur les usages agentiques (avec l’arrivée probable d’une alternative à OpenClaw puisqu’OpenAI a débauché son créateur).

L’architecture en couches : le vrai game-changer

Au-delà des benchmarks, le message stratégique d’OpenAI s’aligne sur un discours que l’on entend de plus en plus souvent : l’avenir des systèmes IA n’est plus au modèle unique qui fait tout, mais à l’orchestration intelligente de modèles de tailles différentes. Un GPT-5.4 Thinking planifie, coordonne et tranche. Des sous-agents Mini exécutent les sous-tâches en parallèle comme l’exploration de codebase, la revue de fichiers, le traitement de documents. Des agents Nano se chargent des micro-opérations : classification, extraction d’entités, tri de candidats, vérifications déterministes.

Une vision qui finalement mime l’organisation typique d’une entreprise humaine avec des projets organisés autour d’un architecte senior qui décide et des ingénieurs juniors qui exécutent. Sauf qu’ici, les « juniors » sont d’une rapidité d’exécution sans égal et coûtent une fraction du prix de l’« architecte ». Pour les entreprises qui construisent des copilotes, des agents conversationnels ou des pipelines de traitement documentaire, cette architecture en couches promet des gains significatifs tout en maîtrisant la facture.

Au final, on retiendra surtout que GPT-5.4 Mini et Nano viennent combler un vide dans la gamme d’OpenAI qui n’avait plus produit de modèles optimisés depuis la sortie de GPT-5 en Août dernier, laissant un boulevard à ses concurrents comme Google (Gemini 3 Flash), Anthropic (Claude 4.5 Haiku) et plus récemment Mistral Small 4. Le retard est désormais rattrapé, et les performances sont au rendez-vous. Mais encore une fois, OpenAI donne davantage l’impression de rattraper un retard et non de conserver une avance.

Dans un monde où Mini tutoie les performances de GPT-5.4 à un tiers du prix, et où Nano peut décrire 76 000 images pour 52 dollars, le gaspillage de tokens sur un modèle surdimensionné n’est vraiment plus une coquetterie technique, c’est un défaut de gouvernance FinOps que les DSI ne peuvent plus laisser passer. Ce qui impose non seulement d’adapter la stratégie IA aux projets mais aussi de mieux maîtriser le potentiel de chaque modèle et chaque variante. Pas simple…

Tarification API (par million de tokens)

GPT-5.4 Thinking : 2,50 $ (entrée) / 15 $ (sortie)

GPT-5.4 Pro : 30 $ (entrée) / 180 $ (sortie)

GPT-5.4 Mini : 0,75 $ (entrée) / 4,50 $ (sortie)

GPT-5.4 Nano : 0,20 $ (entrée) / 1,25 $ (sortie) – API uniquement

____________________________

puis

puis