Après 35 ans à vendre des blueprints et des licences de design, Arm fabrique enfin son propre processeur datacenter. Un monstre de 136 cœurs taillé pour l’IA agentique, co-développé avec Meta. Et l’air de rien, le créateur de puces vient d’entrer en guerre.

Il y a des virages stratégiques qui marquent une industrie. Cette semaine, lors de la conférence Arm Everywhere à San Francisco, le CEO Rene Haas a dévoilé « l’AGI CPU »n le tout premier processeur qu’Arm conçoit, produit (via TSMC) et vend lui-même. En 35 ans d’existence et plus de 325 milliards de puces livrées via ses licenciés, le britannique n’avait jamais franchi cette ligne. C’est désormais chose faite.

Et autant dire que pour un coup d’essai, Arm ne fait pas dans la demi-mesure.

136 cœurs, zéro compromis

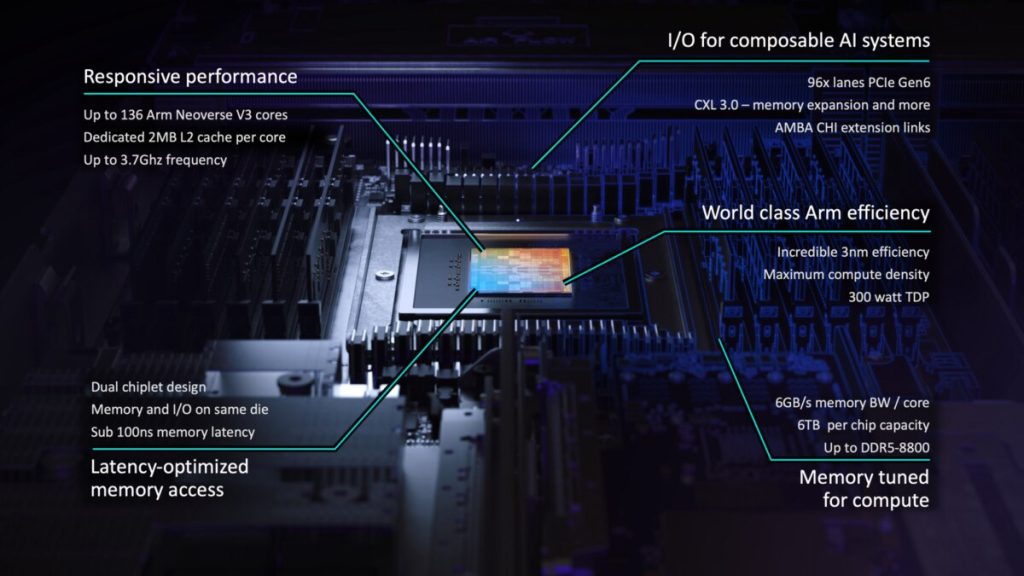

L’AGI CPU embarque jusqu’à 136 cœurs Neoverse V3 répartis sur deux dies gravés en 3 nm chez TSMC. Le tout cadencé à 3,2 GHz en base et 3,7 GHz en boost, pour une enveloppe thermique de 300 watts.

Côté mémoire, le processeur dispose de 12 canaux DDR5 à 8 800 MT/s, soit plus de 800 Go/s de bande passante agrégée soit 6 Go/s par cœur avec une latence inférieure à 100 ns. Chaque cœur profite de 2 Mo de cache L2 dédié, complétés par 128 Mo de cache système partagé (SLC). L’I/O n’est pas en reste : 96 lignes PCIe 6.0 et le support du CXL 3.0.

Détail d’architecture notable : contrairement à de nombreux CPU modernes, les fonctions mémoire et I/O sont intégrées directement sur le même die que le compute, ce qui minimise la latence. Mais il y a un revers à la médaille : comme le processeur est physiquement constitué de deux puces collées ensemble (deux « dies »), le système d’exploitation voit deux zones mémoire distinctes (ce qu’on appelle des « domaines NUMA »). Concrètement, un cœur de calcul situé sur la première puce accède plus vite à « sa » mémoire locale qu’à celle de la seconde puce. C’est un peu comme deux open-spaces dans un même étage : chacun a sa propre armoire à dossiers, et aller chercher un dossier dans l’armoire de l’autre open-space prend un poil plus de temps. Les logiciels doivent en tenir compte pour rester performants.

Mohamed Awad, EVP Cloud AI chez Arm, revendique une approche radicale : pas de SMT, pas d’accélérateurs superflus qui grignotent la surface du die. Un cœur, un thread, une performance déterministe sous charge soutenue. « Les CPU legacy se souciaient de la compatibilité avec les applications héritées. Nous avons spécifiquement refusé d’ajouter quoi que ce soit qui ne serait pas utilisé à 100 % pour la mission de cette puce. C’est une conception en partant d’une feuille blanche », a-t-il déclaré.

Pourquoi maintenant ? Parce que les agents IA ont faim de CPU

Le nom « AGI CPU » est évidemment un exercice de naming sous stéroïdes. On vous rassure tout de suite, non, l’intelligence artificielle générale n’existe toujours pas et n’est pas enfermée dans un processeur. Mais, dans les datacenters de l’ère agentique, les GPU ne font pas tout. C’est en tout cas le message qu’Arm veut faire passer. Les CPU orchestrent, planifient, gèrent la mémoire, le stockage, et déplacent les données entre les clusters d’accélérateurs.

Arm estime que le passage à l’IA agentique va quadrupler la demande en cœurs CPU : de 30 millions de cœurs par gigawatt de datacenter à 120 millions. Un marché que Rene Haas chiffre à 100 milliards de dollars de TAM d’ici la fin de la décennie, contre environ 3 milliards de royalties annuelles aujourd’hui.

Meta en tête de gondole, OpenAI et Cloudflare dans la file

Et cette annonce inattendue s’inscrit dans un partenariat majeur avec Meta : le géant des réseaux sociaux a co-développé la puce et s’engage sur un roadmap multi-générationnel.

L’AGI CPU fonctionnera aux côtés des accélérateurs maison MTIA de Meta, qui prévoit de dépenser jusqu’à 135 milliards de dollars en CAPEX cette année. Santosh Janardhan, responsable de l’infrastructure chez Meta, résume la position de la firme américaine : « Proposer des expériences IA à l’échelle mondiale exige un portefeuille robuste et adaptable de solutions silicium sur mesure. Nous avons travaillé aux côtés d’Arm pour déployer une plateforme compute qui améliore significativement la densité de performance de nos datacenters. »

Derrière Meta, la liste des premiers clients en dit quand même long sur le marché : OpenAI, Cerebras, Cloudflare, F5, SAP, SK Telecom, Positron et Rebellions. Côté ODM, Lenovo, ASRock Rack et Supermicro proposent déjà des systèmes à la commande.

Des racks à haute densité

Arm a validé deux designs de rack conformes à l’Open Compute Project :

– En refroidissement par air : un rack 36 kW accueillant 30 lames pour 8 160 cœurs.

– En refroidissement liquide : un rack 200 kW avec 42 serveurs à 8 nœuds chacun, soit plus de 45 000 cœurs, plus du double de la densité des racks Vera ETL256 de NVIDIA, précise Arm.

L’entreprise revendique des performances par rack deux fois supérieures aux dernières plateformes x86, mais en l’absence de benchmarks indépendants, ce chiffre reste très largement à confirmer. Et la comparaison avec les racks NVidia Vera sera probablement encore plus pertinente.

Arm entre en guerre

Arm, dont le modèle d’affaires reposait sur sa neutralité qui consistait à fournir les mêmes plans à tout le monde sans marcher sur les plates-bandes de personne, entre avec ce premier processeur maison intégral en concurrence frontale avec ses propres licenciés : AWS et son Graviton, Google et son Axion, Microsoft et son Cobalt, Nvidia et ses Grace/Vera, sans oublier Qualcomm (déjà en conflit juridique avec Arm sur les termes de licence). Et bien évidemment également en concurrence avec les vétérans x86 Intel et AMD. Arm a investi 71 millions de dollars et 18 mois pour construire trois salles de lab à Austin, Texas, où l’équipe a dépassé les 1 000 personnes.

Mohamed Awad tente de rassurer : « C’est un marché à 1 000 milliards de dollars. Nos partenaires comprennent que c’est bon pour l’industrie. » Les licenciés historiques apprécieront… ou pas. Probablement pas en fait… Ce qui soulève une autre question clé : en abandonnant sa neutralité, Arm n’est il pas en train d’ouvrir un boulevard à l’architecture open source Risc V ?

L’AGI CPU est attendu en production au second semestre 2026. Si Arm parvient à convaincre au-delà de Meta et de la poignée de clients inauguraux, ce pivot pourrait transformer durablement l’économie du silicium ARM dans le datacenter. En attendant, c’est surtout une option supplémentaire dans un marché du CPU serveur qui n’a jamais été aussi concurrentiel et donc, potentiellement, aussi favorable aux acheteurs. Reste à voir si les promesses de performance tiennent face aux benchmarks indépendants et si Arm peut jouer les combattants sans perdre ses alliés.

____________________________

puis

puis