La promesse de l’IA se heurte encore à une mécanique invisible mais décisive : des pipelines de données fragiles, coûteux et chronophages. Derrière les budgets records, les équipes passent davantage de temps à réparer l’existant qu’à industrialiser les cas d’usage les plus stratégiques comme ceux de l’IA. Et les chiffres du dernier rapport Fivetran sont assez édifiants…

Trois millions de dollars par mois. C’est le coût moyen que les grandes entreprises imputent chaque mois aux interruptions de pipelines et aux perturbations opérationnelles liées à la donnée. À l’heure où l’IA, l’analytics temps réel et la personnalisation tirent les budgets vers le haut, les enseignements du nouveau rapport « Enterprise Data Infrastructure Benchmark Report 2026 », publié par Fivetran, remettent en lumière la question de la solidité de l’architecture qui soutient les ambitions IA des entreprises.

Basée sur une enquête menée auprès de 500 décideurs data et technologiques dans des entreprises de plus de 5 000 salariés, l’étude montre que les organisations consacrent en moyenne 29,3 millions de dollars par an à leurs programmes data. Pourtant, 73 % estiment que leurs initiatives ne répondent pas aux attentes, signe qu’un niveau élevé de dépense ne garantit ni l’efficacité opérationnelle ni le retour sur investissement.

L’intégration, gouffre silencieux des budgets data

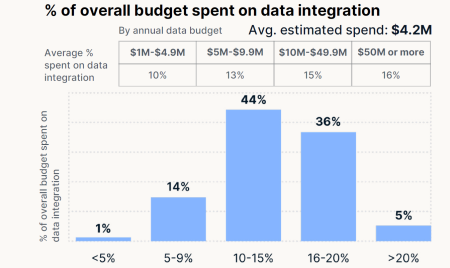

Le goulot d’étranglement est clairement l’intégration. En moyenne, 14 % du budget data, soit environ 4,2 millions de dollars par an, est absorbé par cette brique, entre outils, infrastructures et ressources internes.

À cela s’ajoutent 2,2 millions de dollars par an en main-d’œuvre d’ingénierie dédiée à la seule maintenance des pipelines.

Dans les grandes organisations, la donnée continue donc de mobiliser massivement les équipes sur des tâches de maintien en conditions opérationnelles, au détriment des projets de transformation.

60 heures d’indisponibilité par mois

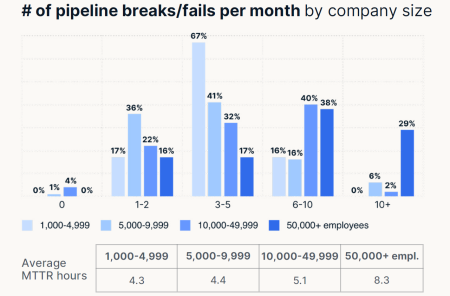

L’étude révèle surtout un déficit de fiabilité devenu structurel. Les entreprises interrogées déclarent en moyenne 4,7 défaillances de pipelines par mois et plus de 60 heures d’indisponibilité mensuelle.

L’impact business estimé atteint 49 600 dollars par heure d’arrêt, et monte à 75 200 dollars dans les plus grandes structures.

À cette échelle, les retards ne relèvent plus de l’incident technique isolé : ils pèsent directement sur les calendriers IA, sur la fraîcheur des données et sur la qualité des décisions.

Près de 30 % des organisations disent d’ailleurs avoir subi des retards d’un mois ou plus sur leurs projets analytiques ou IA à cause de la maintenance ou des interruptions de pipelines.

53 % du temps d’ingénierie absorbé par la maintenance

Autre enseignement majeur : la pression exercée sur les compétences. Les équipes data passent 53 % de leur temps d’ingénierie à maintenir les pipelines.

L’étude évoque en moyenne 328 pipelines à gérer, avec jusqu’à 35 ingénieurs mobilisés, et davantage encore dans les très grands environnements. Ce déséquilibre freine mécaniquement la capacité à avancer sur les sujets les plus attendus du moment : gouvernance, conformité, self-service, analytique prédictive ou industrialisation de l’IA.

Le rapport insiste aussi sur le poids des architectures historiques et des approches maison : Les pipelines legacy ou DIY cassent de 30 à 47 % plus souvent, demandent 2 à 4 heures de réparation supplémentaires et coûtent environ 25 % plus cher par pipeline que les approches ELT entièrement managées.

Au total, 97 % des entreprises interrogées disent avoir vu leurs initiatives IA ou analytiques perturbées par ces faiblesses d’intégration. Le constat est sévère : la maturité data progresse moins vite que les ambitions affichées autour de l’IA.

Moderniser la couche d’intégration

À l’inverse, les organisations qui ont modernisé leur couche d’intégration obtiennent des résultats nettement plus favorables. C’est évidemment là que le rapport de Fivetran tourne quelque peu à l’argumentation marketing. L’optimisation des approches ELT managées étant son fond de commerce.

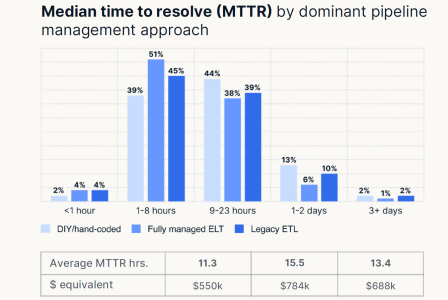

Selon l’étude, le coût moyen par pipeline descend à 1 600 dollars avec une approche ELT managée, contre 1 900 dollars pour les environnements legacy. Le temps médian de résolution revient à 11,3 heures, contre 13,4 à 15,5 heures selon les approches plus anciennes. Surtout, ces entreprises sont près de deux fois plus nombreuses à dépasser leurs objectifs de ROI : 45 %, contre 27 % pour celles qui restent sur des architectures DIY ou historiques.

Une étude qui rappelle une réalité bien connue : La complexité engendre un surplus de maintenance qui devient un frein à l’innovation et à la création de valeur. La bataille ne se joue plus uniquement sur la taille des budgets data, mais sur la capacité à transformer ces dépenses en fondations fiables pour l’analytique et l’IA. Pour Fivetran, l’urgence est là : remettre l’architecture de données au service de l’IA et sortir au plus vite de la logique de réparation permanente.

____________________________

puis

puis