Microsoft ne veut plus seulement héberger les IA des autres. Avec MAI-Transcribe-1, MAI-Voice-1 et MAI-Image-2, le groupe muscle sa pile maison pour capter la voix, produire l’image et verrouiller davantage la chaîne de valeur dans sa si stratégique plateforme Microsoft Foundry.

Redmond a désormais sa propre voix. Et ses propres yeux. Et ses propres oreilles. Mais surtout ses propres modèles frontières. Sa division Microsoft AI, a dévoilé cette semaine trois modèles d’IA fondationnels développés en interne : MAI-Transcribe-1, MAI-Voice-1 et MAI-Image-2. Ils disponibles immédiatement via Microsoft Foundry et le MAI Playground. Et pas un logo OpenAI en vue.

Etonnant ? Pas du tout. Plutôt l’épanouissement d’une stratégie multimodale qui veut rendre à Microsoft son indépendance et son autonomie en matière de choix des modèles et d’innovation vers l’ère de l’AGI (intelligence artificielle générale).

La stratégie IA de Microsoft : une hydre à quatre têtes

Microsoft joue en effet simultanément sur quatre tableaux en matière de modèles d’IA. D’un côté, le partenariat historique avec OpenAI (plus de 13 milliards de dollars d’investissement, GPT-5.x au cœur de Copilot, droits de licence sécurisés jusqu’en 2032).

De l’autre, une intégration croissante de modèles Claude d’Anthropic dans certaines fonctionnalités de Copilot, preuve que Redmond ne met pas tous ses œufs dans le même panier.

Troisième axe : les modèles ouverts Phi (Phi-4, Phi-4-Mini, et le fameux PhiSilica qui fait tourner les fonctions IA directement dans le NPU des Copilot+ PC sous Windows 11).

Quatrième et dernier axe, celui qui nous intéresse aujourd’hui : la division Microsoft AI (MAI) et sa « MAI Superintelligence team » créée en novembre 2025 pour développer des modèles propriétaires de classe mondiale.

Jusqu’en octobre 2025, Microsoft était contractuellement empêché de développer ses propres modèles d’intelligence artificielle générale. La renégociation de ses accords de partenariat avec OpenAI en septembre 2025 a changé fondamentalement la donne : Microsoft a conservé ses droits de licence sur tout ce que produit OpenAI jusqu’en 2032, obtenu 250 milliards de dollars d’engagements Azure et, surtout, acquis la liberté de construire des modèles concurrents.

Une liberté qui lui permet aujourd’hui de diffuser à grande échelle ses trois premiers modèles propriétaires spécialisés.

MAI-Transcribe-1 : transcrire et traduire la voix

Le premier modèle de la fratrie est aussi le plus immédiatement accessible. MAI-Transcribe-1 est un modèle speech-to-text qui repose sur un décodeur texte de type transformer couplé à un encodeur audio bidirectionnel. Il accepte les fichiers MP3, WAV et FLAC jusqu’à 200 Mo et les convertit en texte. Un modèle conçu pour tous ceux qui doivent retranscrire en texte des enregistrements audio.

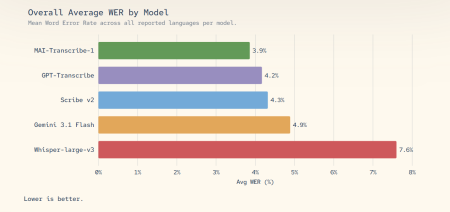

Côté performances, les chiffres parlent d’eux-mêmes : le modèle affiche un taux d’erreur mot (WER) moyen de 3,8 % sur le benchmark FLEURS, surpassant Whisper-large-v3 d’OpenAI sur les 25 langues testées, Gemini 3.1 Flash de Google sur 22 d’entre elles, et ElevenLabs Scribe v2 sur 15 langues. Sa vitesse de transcription en batch est 2,5 fois supérieure à l’offre Azure Fast existante de Microsoft. Et le tout avec moitié moins de GPU monopolisés que la concurrence.

Fait notable : l’équipe qui l’a construit ne comptait que 10 personnes.

MAI-Transcribe-1:va devoir, sur le terrain des entreprises, confirmer ses qualités face à la concurrence de Whisper et GPT-Transcribe (OpenAI), Gemini Flash (Google), Scribe v2 (ElevenLabs). Mais le modèle revendique ses forces : une forte intégration à tout l’écosystème Azure et un tarif très accessible (0,36 $ par heure de transcription), ce que Microsoft présente comme le meilleur rapport qualité-prix parmi les grands fournisseurs cloud. La diarisation (identification des locuteurs) et le streaming temps réel sont annoncés pour bientôt. Microsoft teste déjà des intégrations de ce modèle dans le mode vocal de Copilot et dans Teams.

MAI-Voice-1 : 60 secondes d’audio en une seconde

Deuxième modèle de la salve, MAI-Voice-1 est le pendant synthèse vocale de MAI-Transcribe-1. Ce modèle de génération vocale haute-fidélité est capable de produire 60 secondes d’audio expressif en moins d’une seconde sur un seul GPU à partir d’un simple texte. La voix générée préserve l’identité du locuteur même sur du contenu long, avec une richesse émotionnelle et une expressivité qui tranchent avec les voix synthétiques robotiques d’antan.

La nouveauté clé : la possibilité de créer sa propre voix personnalisée dans Microsoft Foundry à partir de quelques secondes d’audio seulement. Un atout considérable pour les développeurs qui créent des agents vocaux ou des expériences audio sur mesure.

Là encore, MAI-Voice-1 arrive en terrain truffé de concurrents dont les plus connus sont ElevenLabs, Google Cloud TTS et OpenAI Audio. Le modèle est facturé 22 $ par million de caractères (soit à peine plus d’un euro l’heure vocale). Le modèle est déjà accessible via Copilot Audio Expressions et Copilot Podcasts.

MAI-Image-2 : top 3 mondial et déjà dans PowerPoint

Le troisième larron n’est pas vraiment un nouveau venu : MAI-Image-2 avait déjà fait ses débuts en mars sur le classement Arena.ai, se hissant directement à la troisième place des familles de modèles texte-vers-image, derrière Gemini 3.1 Flash et GPT Image 1.5.

Développé en collaboration avec des photographes, designers et créateurs visuels, le modèle excelle sur l’éclairage naturel, la fidélité des tons de peau et le rendu de texte incrusté dans les images.

Les temps de génération sont au moins deux fois plus rapides que la génération précédente (MAI-Image-1) sur Foundry et Copilot. Des déploiements sont en cours dans Bing Image Creator et PowerPoint.

WPP, l’un des plus grands groupes de communication et marketing au monde, fait partie des premiers partenaires entreprise. Rob Reilly, son directeur créatif mondial, ne mâche pas ses mots : « MAI-Image-2 est un véritable game-changer. C’est une plateforme qui non seulement répond aux nuances de la direction créative, mais respecte profondément le savoir-faire impliqué dans la génération d’images prêtes pour des campagnes réelles. »

Des qualités qui lui seront bien utiles pour s’imposer face à GPT-Image-1.5 d’OpenAI, Imagen 3 et Nano Banana de Google, Midjourney, Flux, Firefly… Là encore, Microsoft compte sur la forte intégration à l’écosystème Azure et Microsoft Foundry ainsi qu’une tarification agressive (5 $ par million de tokens en entrée texte, 33 $ par million de tokens en sortie image, soit dans les 5 centimes l’image générée).

Déploiement et écosystème : Foundry au centre du jeu

Les trois modèles sont disponibles dès maintenant via Microsoft Foundry (l’ex-Azure AI Foundry, lui-même ex-Azure AI Studio). La plateforme sert déjà plus de 80 000 entreprises, dont 80 % du Fortune 500.

Destiné aux développeurs et aux curieux, le service « MAI Playground » permet aussi de les tester en toute simplicité, mais uniquement depuis les États-Unis pour l’instant.

Concrètement, MAI-Transcribe-1 et MAI-Voice-1 forment ensemble un pipeline audio complet qui, combiné à un LLM au choix du client, tourne intégralement sur l’infrastructure Microsoft sans autre dépendance technologique. C’est là que la stratégie prend tout son sens : Microsoft n’a pas besoin de battre OpenAI sur chaque benchmark. Il lui suffit d’être suffisamment compétitif pour que les entreprises déjà clientes d’Azure choisissent l’option intégrée plutôt que l’alternative tierce.

Et MAI-1 dans tout ça ?

On ne saurait conclure sans évoquer l’éléphant dans la pièce : MAI-1. Ce modèle de langage (LLM) généraliste, toujours en preview limitée, a été entraîné sur 15 000 GPU NVIDIA H100 et se concentre sur le suivi d’instructions et les requêtes du quotidien. Il représente la première tentative de Microsoft de produire un LLM frontière maison, capable de rivaliser un jour avec GPT-5.x, Claude Opus ou Gemini 3.1 Pro.

Mais il faudra encore un peu de patience. Selon certaines sources internes, l’équipe « super-intelligence » ne compte pas commercialiser de modèles de langage de classe frontière, avant deux ans. En attendant, l’entreprise a commencé à déployer des clusters de puces NVIDIA GB200 et monte en puissance sur ses propres puces MAIA pour accélérer l’inférence.

Reste que la stratégie de Microsoft semble enfin se stabiliser et gagner en assurance. Les trois modèles MAI dévoilés cette semaine sont à bien y regarder des fondations indispensables (les yeux, les oreilles et la voix) d’un édifice que l’on devine bien plus ambitieux. En attendant, Redmond a au moins prouvé une chose : on peut dépenser 13 milliards de dollars chez un partenaire et préparer quand même un plan B pour ne pas se retrouver trop dépendant. Une leçon pour les DSI à n’en pas douter.

____________________________

puis

puis