Anthropic dévoile Claude Mythos, un modèle IA capable de découvrir et d’exploiter des vulnérabilités zero-day dans tous les grands OS et navigateurs. Un outil qui met en péril toute la production logicielle actuelle s’il tombe entre de mauvaises mains. Le Project Glasswing réunit AWS, Apple, Google, Microsoft et huit autres géants pour s’assurer que cette puissance serve uniquement à des fins défensives. Une nouvelle ère IA s’ouvre, une nouvelle ère cyber aussi.

Il y a deux ans, Anthropic était encore le petit challenger discret de la Silicon Valley. Aujourd’hui, c’est un rouleau compresseur. Fin 2025, le chiffre d’affaires annualisé de l’entreprise tournait autour de 9 milliards de dollars. Il a depuis plus que triplé (en à peine 3 mois!) pour dépasser les 30 milliards, décoiffant au passage OpenAI et ses quelque 24 milliards de dollars d’ARR. Du jamais vu dans l’histoire de la tech.

Le secret de cette réussite ? Un indéniable savoir-faire et une stratégie B2B assumée depuis le départ : plus de 1 000 clients entreprises dépensent chacun plus d’un million de dollars par an, un chiffre qui a doublé en moins de deux mois. Là où OpenAI a bâti son empire sur la viralité grand public de ChatGPT, Anthropic a choisi de séduire les DSI, les développeurs et les RSSI. Les modèles Claude sont devenus la référence en entreprise d’autant qu’ils sont les seuls modèles frontières disponibles simultanément sur AWS Bedrock, Google Vertex AI et Microsoft Foundry.

Mais Anthropic se voit aujourd’hui contraint de prendre davantage de temps et de précautions. Car à force de progresser, ses IA sont devenues de véritables experts dans de nombreux domaines, dépassant les capacités humaines, comme en Cybersécurité par exemple.

Claude Mythos : ce qu’il est (et ce qu’il n’est pas)

Annoncé cette semaine, Claude Mythos Preview est un modèle frontière généraliste entraîné par Anthropic mais qui ne sera pas publié. Ce n’est pas un produit. Ce n’est pas le successeur de Claude Opus 4.6. Ce n’est pas un modèle que vous pourrez appeler via une API demain matin en sirotant votre café. « Mythos » est un prototype de recherche dont les capacités en cybersécurité sont telles, qu’elles ont contraint Anthropic à changer de stratégie.

Pourquoi ? Parce que Mythos fait des choses qu’aucun modèle n’avait jamais faites. Il a découvert des milliers de vulnérabilités zero-day de sévérité élevée, y compris dans tous les grands systèmes d’exploitation et tous les grands navigateurs web. Et il ne se contente pas de les trouver : là où Opus 4.6 affichait un taux de création d’exploits fonctionnels proche de zéro, Mythos Preview atteint 72,4 %.

Quelques exemples qui donnent le vertige. Mythos a découvert une faille vieille de 27 ans dans OpenBSD (réputé l’un des OS les plus sécurisés au monde) permettant de crasher n’importe quelle machine à distance par simple connexion. Il a déniché une vulnérabilité de 16 ans dans FFmpeg, au sein d’une ligne de code que les outils de test automatisé existants avaient traversée cinq millions de fois sans jamais rien détecter !

Et pour couronner le tout, le modèle a en toute autonomie chaîné plusieurs failles du noyau Linux pour escalader les privilèges d’un simple utilisateur jusqu’au contrôle total de la machine.

C’est une dure réalité : Mythos ne fait pas seulement mieux que les modèles IA actuels. Il fait mieux que les millions d’yeux humains qui ont parcouru ces lignes de codes depuis des années. Et il le fait en quelques minutes.

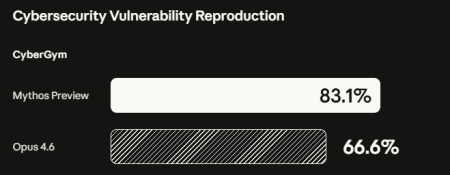

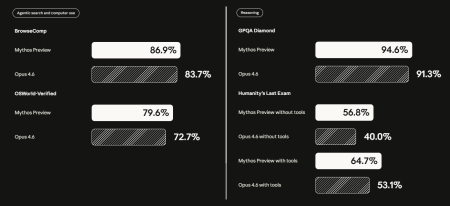

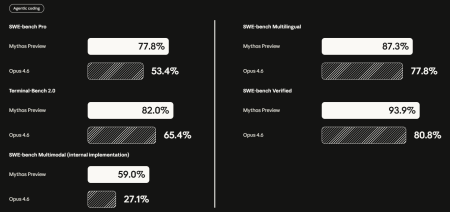

Sur les benchmarks, l’écart avec Opus 4.6 est plus que significatif : 83,1 % contre 66,6 % sur CyberGym, 93,9 % contre 80,8 % sur SWE-bench Verified, 77,8 % contre 53,4 % sur SWE-bench Pro. On ne parle plus d’amélioration incrémentale, mais d’un saut qualitatif. Claude Mythos Preview est un hacker surdoué, un moteur à dénicher des zero-days et fabriquer des exploits.

Des ingénieurs sans formation, sous le contrôle attentif d’Anthropic, en sécurité ont ainsi demandé à Mythos de chercher des failles d’exécution de code à distance pendant la nuit, et se sont réveillés le lendemain matin face à un exploit complet et fonctionnel.

Conclusion Claude Mythos Preview est puissant… et dangereux. Trop dangereux pour être libéré. Son usage doit impérativement être contrôlé, surveillé, monitoré.

Project Glasswing : le bouclier avant la tempête

Face à ce constat, Anthropic a fait un choix radical : ne pas publier officiellement Mythos, et créer une coalition défensive pour l’encadré et préparé l’avenir. C’est le Project Glasswing, du nom du papillon aux ailes transparentes, Greta oto, qui peut se rendre invisible pour échapper aux prédateurs.

L’initiative réunit AWS, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorganChase, la Linux Foundation, Microsoft, NVIDIA et Palo Alto Networks. Il ne manque à l’appel qu’OpenAI. Ces partenaires disposent d’un accès à Mythos Preview pour scanner et corriger les failles de leurs propres systèmes. Plus de 40 organisations supplémentaires ont également été invitées, et Anthropic met sur la table 100 millions de dollars de crédits d’utilisation ainsi que 4 millions de dollars de dons directs à des organisations de sécurité open source.

L’objectif numéro de cette initiative est de s’assurer qu’un tel modèle soit impérativement entre les mains des défenseurs avant que les attaquants n’accèdent à des capacités équivalentes.

Le risque est grand. L’opportunité de fiabiliser l’écosystème logiciel l’est tout autant. Jim Zemlin, CEO de la Linux Foundation, rappelle que le logiciel open source constitue l’immense majorité du code des systèmes modernes, et que ses mainteneurs n’ont historiquement jamais eu les moyens de se payer des équipes de sécurité dédiées. En ce sens Mythos et Project Glasswing changent totalement la donne. Il faut en profiter maintenant et s’assurer que toutes les briques fondamentales de nos logiciels et services numériques passent par le crible de Mythos et soient corrigées avant que les cyberattaquants ne s’emparent d’une telle puissance. Mais la fenêtre d’avantage défensif est étroite. D’autres modèles atteindront forcément prochainement ce niveau de capacité, et pas forcément entre des mains bienveillantes.

Vers une nouvelle vague de LLM à risques accrus

Ce que révèle Glasswing, au-delà du coup de communication indéniable, c’est un changement de paradigme dans la relation entre IA et cybersécurité. Les modèles de langage ne sont plus seulement des assistants de codage : ils sont en passe de devenir les meilleurs pentesteurs de la planète. Et la prolifération est inévitable. Si Anthropic y parvient aujourd’hui, d’autres, y compris des acteurs étatiques hostiles ou des startups moins scrupuleuses, y parviendront demain.

C’est ici que l’AI Act européen entre en scène. Le règlement, qui impose des obligations renforcées aux modèles d’IA à « risque systémique », semble avoir été écrit précisément pour ce type de situation. Un modèle capable de découvrir et d’exploiter autonomement des failles zero-day dans des infrastructures critiques coche toutes les cases du risque systémique au sens du texte européen. La question n’est plus de savoir si la régulation est nécessaire, mais si elle sera assez rapide pour encadrer cette nouvelle génération de modèles avant que les capacités ne se diffusent hors de tout contrôle.

Anthropic a choisi la transparence et la coalition. C’est à saluer. Mais il serait naïf de croire que tous les développeurs de modèles frontières feront le même choix. L’ère des LLM offensifs vient de commencer. Dans un premier temps, la cybersécurité ne sera plus jamais la même. En attendant bien pire ?

____________________________

puis

puis