Depuis plus d’un an, NVIDIA fait miroiter sa plateforme « Vera Rubin ». Mais jusqu’ici, c’est surtout le GPU Rubin qui avait volé la vedette, laissant le CPU Vera dans l’ombre. À l’occasion de sa conférence GTC 2026, le leader de l’infrastructure IA a enfin mis un coup de projecteur sur le CPU Vera en faisant un rouage essentiel de l’inférence à l’ère agentique. Mais ce n’est pas tout. Car la plateforme Vera Rubin combine bien plus de technologies, y compris les LPU (Language Processing Units) du concepteur Groq récemment acquis par NVIDIA.

Pour comprendre l’importance de Vera, il faut remonter à Grace, le premier CPU datacenter conçu par NVIDIA. Lancé en 2023, Grace embarquait 72 cœurs ARM Neoverse V2, une mémoire LPDDR5X capable de délivrer jusqu’à 546 Go/s de bande passante par puce (et jusqu’à 1 To/s en configuration Superchip à 144 cœurs), le tout relié aux GPU via la technologie NVLink-C2C à 900 Go/s. Avec Grace, NVIDIA promettait deux fois les performances par watt des CPU x86 traditionnels, dans une enveloppe thermique de 500 W pour le Superchip (combinant CPU Grace et GPU Blackwell) complet, mémoire incluse.

Le CPU Grace a d’abord été déployé comme « partenaire silencieux » des GPU Hopper puis Blackwell, au sein des systèmes Grace Hopper et Grace Blackwell. Mais un tournant s’est opéré début 2026 : Meta a signé un accord pluriannuel incluant le premier déploiement à grande échelle de CPU Grace en mode autonome. Des laboratoires nationaux américains, Los Alamos, le Lawrence Berkeley National Laboratory, le TACC au Texas, ont emboîté le pas en adoptant massivement les Superchips « GB200 » et en faisant dès lors reposer le cœur d’exécution de l’environnement de calcul sur l’implémentation ARM de Grace. Le CPU NVIDIA est ainsi sorti de l’ombre des GPU pour exister en tant qu’infrastructure à part entière et a, à lui seul, fait bondir les parts de marché d’ARM dans l’univers des serveurs d’entreprise et des HPC.

Vera : 88 cœurs Olympus taillés pour l’IA agentique

Vera est le successeur direct de Grace, une sorte d’évolution sous stéroïdes. NVIDIA abandonne les cœurs Arm Neoverse au profit de cœurs « Olympus » entièrement conçus en interne. Et la puce en embarque 88 au total. Chaque cœur supporte le « Spatial Multithreading » (deux tâches simultanées), afin de garantir des performances régulières et prévisibles dans les environnements multi-locataires des AI factories.

Vera est le successeur direct de Grace, une sorte d’évolution sous stéroïdes. NVIDIA abandonne les cœurs Arm Neoverse au profit de cœurs « Olympus » entièrement conçus en interne. Et la puce en embarque 88 au total. Chaque cœur supporte le « Spatial Multithreading » (deux tâches simultanées), afin de garantir des performances régulières et prévisibles dans les environnements multi-locataires des AI factories.

Côté mémoire, Vera embarque la deuxième génération du sous-système basse consommation de NVIDIA, toujours en LPDDR5X, mais cette fois avec 1,2 To/s de bande passante, soit le double de celle des CPU généralistes actuels, pour une consommation à nouveau divisée par deux. L’interconnexion NVLink-C2C monte à 1,8 To/s de bande passante cohérente, sept fois celle du PCIe Gen 6, pour un dialogue ultra-rapide entre CPU et GPU.

Dans l’esprit du fabriquant, ce nouveau CPU n’accompagne plus simplement le modèle IA, il le pilote. Dans l’ère de l’IA agentique, où les systèmes raisonnent, planifient des tâches, exécutent du code et valident des résultats, le CPU est au cœur de l’orchestration. Vera promet ainsi des résultats deux fois plus efficaces et 50 % plus rapides que les CPU traditionnels x86 à l’échelle du rack.

Et NVIDIA ne compte pas déployer son Vera uniquement sous forme de Superchips mais aussi de CPU assemblés au sein de « Vera Racks », bâtis autour de l’architecture modulaire NVIDIA MGX.

Et Jensen Huang de confirmer « nous n’avions pas anticipé de commercialiser des CPU seuls (sans les coupler aux GPU). Et voilà que désormais nous vendons beaucoup de CPU ‘standalones’ et c’est en train de devenir un business multi-milliards de dollars pour nous ».

Au passage, NVIDIA confirme que la plateforme « Vera Rubin » est bien déjà entrée en production. Les premiers déploiements sont attendus au second semestre 2026 chez Alibaba, ByteDance, Meta, Oracle Cloud Infrastructure, CoreWeave, Lambda, Nebius et Nscale, ainsi que chez les fabricants Dell, HPE, Lenovo, Supermicro et une dizaine d’autres partenaires MGX. Microsoft annonce même avoir déjà démarré la validation des systèmes Vera Rubin « NVL72 » dans son Cloud Azure, confirmant que la plateforme délivre 3,6 exaflops de performance IA, cinq fois plus que la précédente plateforme GB200.

Vera Rubin : sept puces, cinq racks, un superordinateur

Car si Vera est bien le CPU, « Vera Rubin » désigne l’écosystème complet et la plateforme qui succède à l’ère « Grace-Blackwell » et les superchips GB200.

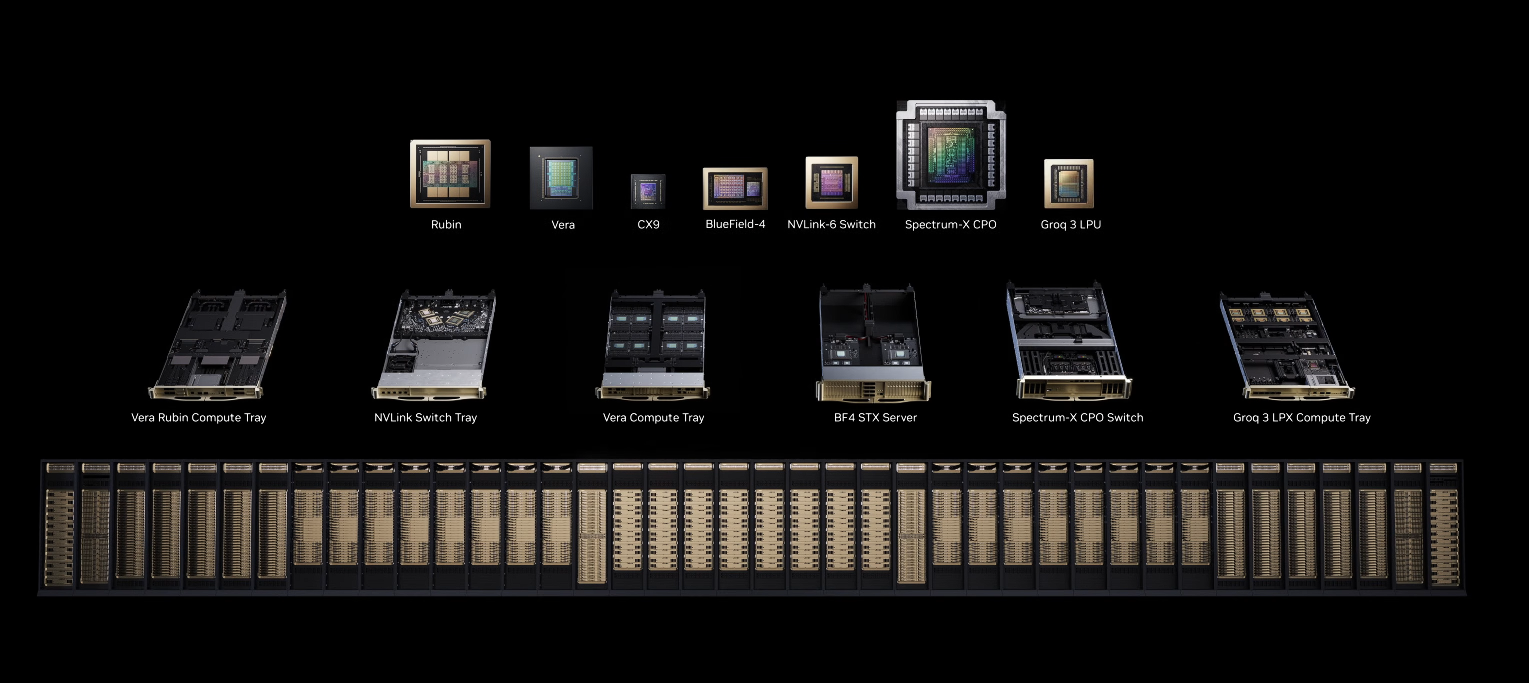

La nouvelle plateforme « Vera Rubin » rassemble et combine en réalité sept puces désormais toutes en production : le CPU Vera, le GPU Rubin, le switch NVLink 6, le SuperNIC ConnectX-9, le DPU BlueField-4, le switch Ethernet Spectrum-6… et le tout nouveau Groq 3 LPU, issu du rachat de Groq finalisé fin 2025 pour 20 milliards de dollars.

Ces sept composants alimentent cinq types de racks spécialisés, pensés pour fonctionner ensemble comme un unique superordinateur à l’échelle du POD.

Des racks spécialisés pour chaque étage de l’AI factory

Concrétisation directe de cette plateforme, le nouveau rack « Vera Rubin NVL72 » intègre 72 GPU Rubin et 36 CPU Vera, reliés par NVLink 6 avec 260 To/s de bande passante, accompagnés de SuperNIC ConnectX-9 et de DPU BlueField-4. Les gains annoncés sont vertigineux : il faudrait quatre fois moins de GPU qu’avec la plateforme Blackwell pour entraîner les grands modèles mixture-of-experts, et le débit d’inférence par watt serait multiplié par dix, le tout à un dixième du coût par token.

Mais le NVL72 n’est qu’une pièce du puzzle. Le Vera CPU Rack empile 256 CPU Vera refroidis par liquide, capables de faire tourner plus de 22 500 environnements CPU simultanés. NVidia y voit une infrastructure idéale pour le reinforcement learning et l’inférence agentique, où d’innombrables agents doivent tester et valider en parallèle les résultats générés par les GPU.

Le Groq 3 LPX est un rack d’inférence IA annoncé par NVIDIA pour sa plateforme Vera Rubin. C’est une infrastructure matérielle conçue pour faire tourner des modèles très volumineux avec une latence très faible, notamment pour les systèmes d’IA agentique. Le rack Groq 3 LPX embarque 256 processeurs LPU (Language Processing Unit) dotés de 128 Go de SRAM on-chip et 640 To/s de bande passante scale-up, ciblant l’inférence ultra-rapide à faible latence pour les modèles à mille milliards de paramètres et les contextes d’un million de tokens. Pour rappel, les LPU sont des processeurs spécialisés pour l’inférence spécifique des LLM en temps réel.

Associé au NVL72, le rack Groq 3 LPX promet un débit d’inférence par mégawatt multiplié par 35 !

Le rack de stockage BlueField-4 STX transforme le DPU BlueField-4 (lui-même combinaison d’un CPU Vera et d’un SuperNIC ConnectX-9) en couche de stockage native pour l’IA, optimisée pour le cache clé-valeur des LLM. Avec le framework DOCA Memos, le débit d’inférence peut bondir de cinq fois par rapport aux architectures de stockage généralistes.

Enfin, le rack Ethernet Spectrum-6 SPX apporte la connectivité est-ouest entre racks, avec des optiques co-packagées (CPO) qui améliorent l’efficacité énergétique optique d’un facteur cinq et la résilience d’un facteur dix.

1 000 milliards de dollars : la prophétie de Jensen Huang

« Au moins 1 000 milliards de dollars de commandes attendues entre Blackwell et Vera Rubin d’ici 2027 »… Telle est la prédiction avancée par Jensen Huang en clôture de keynote. L’an dernier à la même époque, la projection était de 500 milliards. En doublant la mise, le fondeur de NVIDIA envoie un signal sans ambiguïté : la demande d’infrastructure IA ne fait que s’accélérer.

Pour justifier cette ambition, le CEO nous explique que NVIDIA serait aujourd’hui « l’infrastructure IA la moins coûteuse au monde » grâce à l’universalité de sa plateforme, capable de faire tourner tous les modèles IA de tous les domaines. 60 % du chiffre d’affaires provient des cinq plus grands hyperscalers, les 40 % restants se répartissant entre cloud souverain, entreprises, industrie, robotique et edge.

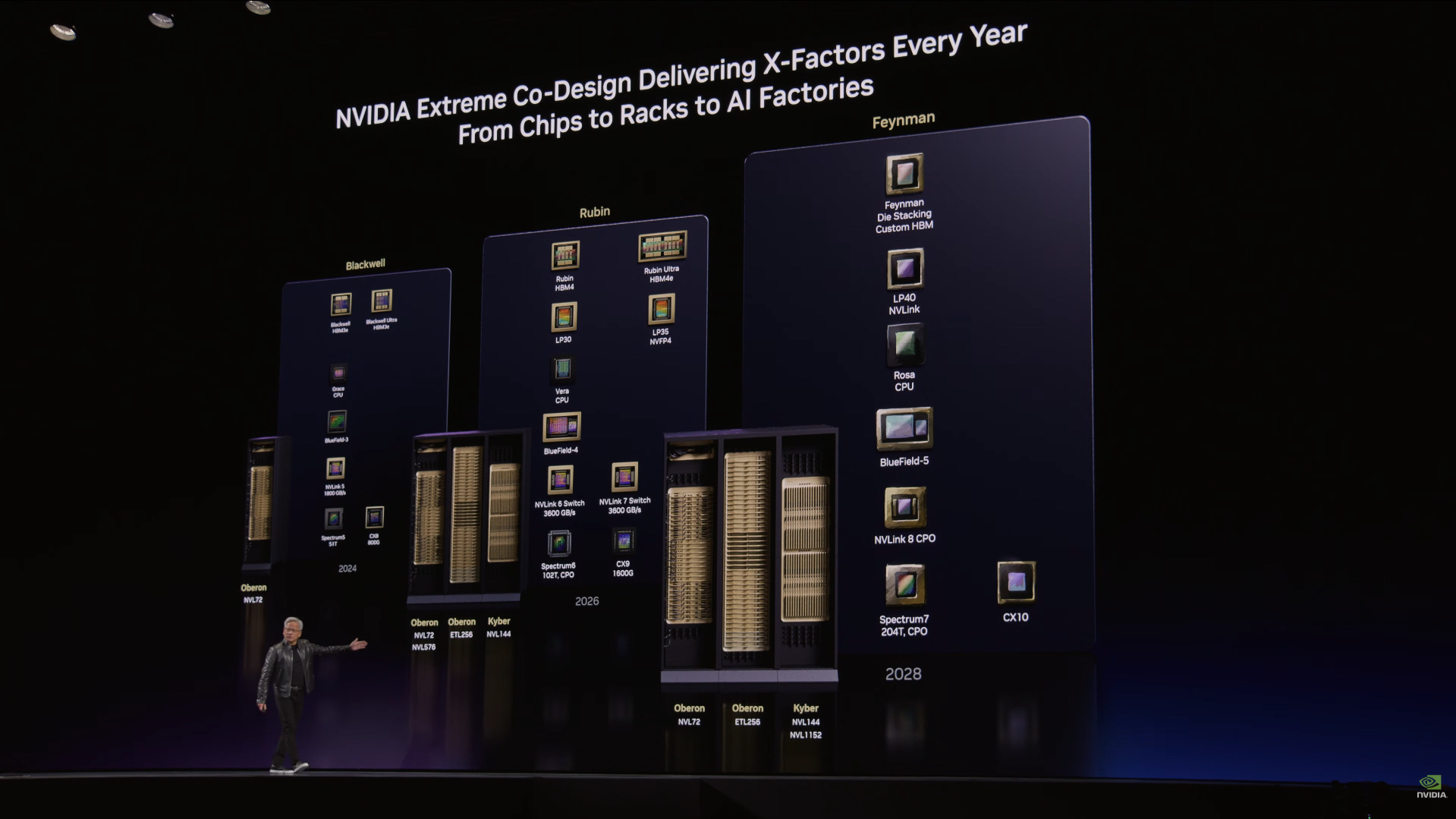

Au final on retiendra surtout qu’avec Vera Rubin, NVIDIA ne se contente plus de vendre des GPU : le fondeur vend des AI factories clé en main, de la puce au rack, du cuivre à la fibre, qui combine des briques très complémentaires pour booster les capacités d’inférence sans exploser les consommations d’énergie. Et pour qui douterait encore de la feuille de route, Jensen a déjà glissé un aperçu de l’après Vera Rubin : l’architecture « Feynman » sera dotée d’un nouveau CPU baptisé Rosa (en hommage à Rosalind Franklin), d’un LPU nouvelle génération LP40 et bien évidemment d’un nouveau GPU encore gardé secret… Et, suivant Elon Musk dans ses « délires » très controversés, Nvidia anticipe même un projet de data center spatial, Vera Rubin Space-1.

L’IA agentique n’a décidément pas fini de faire tourner les compteurs des centrales énergétiques comme des investisseurs.

____________________________

puis

puis