Après le coup de tonnerre Claude Mythos chez Anthropic, OpenAI poursuit sa riposte cyber. GPT-5.4-Cyber avait ouvert la voie. Lancé cette semaine, GPT-5.5-Cyber affine la recette avec des modèles plus permissifs, mais réservés aux défenseurs vérifiés. Pour l’accompagner, OpenAI lance son alternative au projet Glasswing d’Anthropic : Daybreak. Il ne s’agit plus seulement de contrôler l’accès à une IA cyber de haut niveau, mais de l’insérer dans une chaîne complète de détection, de priorisation, de correction et de validation des vulnérabilités. Bref, la cybersécurité par IA entre dans l’ère des modèles VIP… branchés directement sur l’atelier de réparation logicielle.

Depuis Mythos, l’IA cyber a changé de régime. Il y a un avant et un après. Début avril, Anthropic a créé un petit séisme en présentant Claude Mythos Preview, un modèle généraliste mais particulièrement doué pour les tâches de sécurité informatique. Trop doué, même. Anthropic explique que Mythos est capable d’identifier et d’exploiter des vulnérabilités zero-day dans les principaux systèmes d’exploitation et navigateurs, avec parfois des chaînes d’exploitation complexes. Autrement dit : pas vraiment le genre de jouet à déposer en libre-service sur Internet. Anthropic a donc lancé Project Glasswing, une initiative fermée, réservée à un cercle restreint de partenaires chargés de renforcer les logiciels critiques avant que des capacités comparables ne se généralisent.

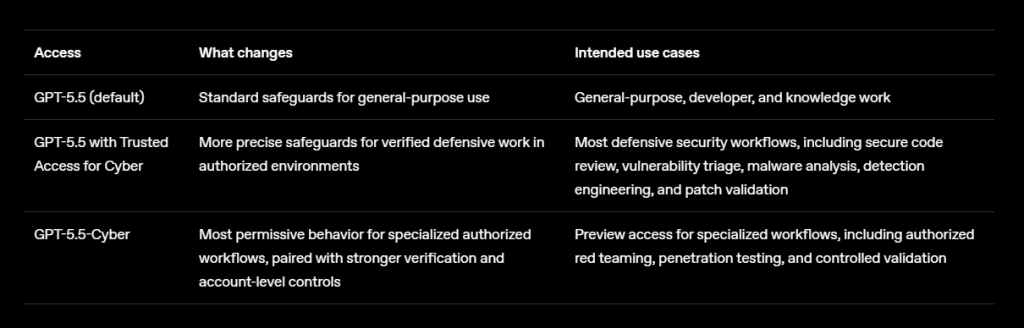

OpenAI n’a pas tardé à répondre. Le 14 avril, l’entreprise présentait GPT-5.4-Cyber, une variante de GPT-5.4 entraînée pour être plus « cyber-permissive », c’est-à-dire moins prompte à refuser des demandes sensibles lorsqu’elles viennent de défenseurs vérifiés. Au menu : analyse de vulnérabilités, reverse engineering binaire, triage, validation de correctifs et workflows défensifs avancés. Avec comme chez Anthropic la volonté d’en restreindre l’accès : le modèle n’est accessible qu’au travers du programme « Trusted Access for Cyber », avec vérification des utilisateurs et paliers d’accès.

Un peu à la surprise générale, OpenAI lançait quelques jours plus tard son GPT-5.5, sa nouvelle génération de modèle de raisonnement pour le travail professionnel, l’agentique, le code, la recherche en ligne et les tâches multi-outils. Dans ChatGPT, cette génération est notamment exploitée via GPT-5.5 Thinking pour les tâches plus complexes.

GPT-5.5-Cyber : pas plus libre, plus contrôlé

Cette semaine, OpenAI lance sa variante « Cyber ». « GPT-5.5-Cyber » succède donc à « GPT-5.4-Cyber » moins d’un mois après la sortie de ce dernier. Mais son accès est encore plus restreint. Seuls les défenseurs bien identifiés, notamment ceux qui protègent des infrastructures critiques, peuvent y accéder. OpenAI parle d’une disponibilité en « limited preview » pour des workflows spécialisés de cybersécurité. Une approche finalement très alignée sur celle d’Anthropic avec derrière une petite couche de marketing typiquement américaine afin d’entretenir le suspense. Et de faire monter le Buzz. Anthropic a clairement réussi le coup avec Mythos, alors OpenAI ne s’en prive pas.

Bien évidemment, le modèle embarque une pléthore de garde-fous et probablement de mécanismes de surveillance censés bloquer le vol d’identifiants, la persistance furtive, le déploiement de malware ou l’exploitation de systèmes tiers qui restent actifs même pour les utilisateurs approuvés dans Trusted Access for Cyber. Ces derniers néanmoins obtiennent moins de refus automatiques sur les tâches légitimes, comme l’identification de vulnérabilités, l’analyse de malware, le reverse engineering, la détection ou la validation de patchs.

Reste qu’OpenAI souhaite rapidement sortir son modèle du mode preview et en offrir un accès plus large. Et pour cela, l’éditeur compte ajouter une couche de sécurité opérationnelle : à partir du 1er juin 2026, les utilisateurs individuels accédant aux modèles cyber les plus permissifs devront activer Advanced Account Security, ou passer par une authentification résistante au phishing via leur SSO d’entreprise. Bref, le modèle sera plus permissif, mais l’utilisateur doit être plus traçable.

La force : accélérer les défenseurs, pas écrire des PowerPoint de RSSI

La promesse de GPT-5.5-Cyber n’est pas de faire un joli résumé de rapport d’audit. C’est d’aider les équipes sécurité à gagner du temps sur les tâches où le temps manque toujours : comprendre une faille, vérifier son exploitabilité en environnement autorisé, produire une preuve de concept défensive, analyser du code compilé, générer des règles de détection, documenter un correctif, puis vérifier qu’il tient.

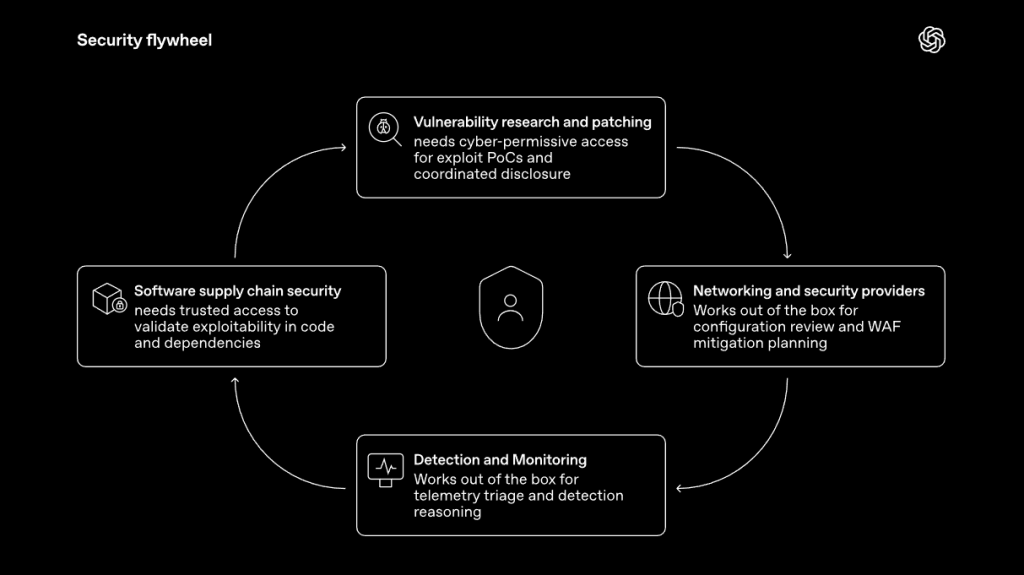

OpenAI décrit une logique de « security flywheel » : les chercheurs identifient et qualifient les failles, les outils de supply chain empêchent les dépendances dangereuses d’entrer en production, les EDR et SIEM détectent les signaux d’exploitation, et les fournisseurs réseau ou sécurité déploient des règles de protection pendant que les correctifs se généralisent. C’est moins glamour qu’un robot hacker hollywoodien, mais beaucoup plus proche de la réalité d’un SOC, un lundi matin.

L’autre force est écosystémique. OpenAI ne veut pas seulement commercialiser son modèle. Il veut l’insérer dans les chaînes existantes de la cybersécurité, avec des partenaires comme Cisco, CrowdStrike, Palo Alto Networks, Zscaler, Cloudflare, Akamai, Fortinet, Intel, Qualys, Rapid7, Tenable, Trail of Bits, SpecterOps, Snyk, Semgrep ou Socket. L’objectif est évident : faire de GPT-5.5-Cyber un accélérateur transversal, du développement logiciel jusqu’à la réponse à incident.

Un modèle moins bridé mais pas forcément meilleur

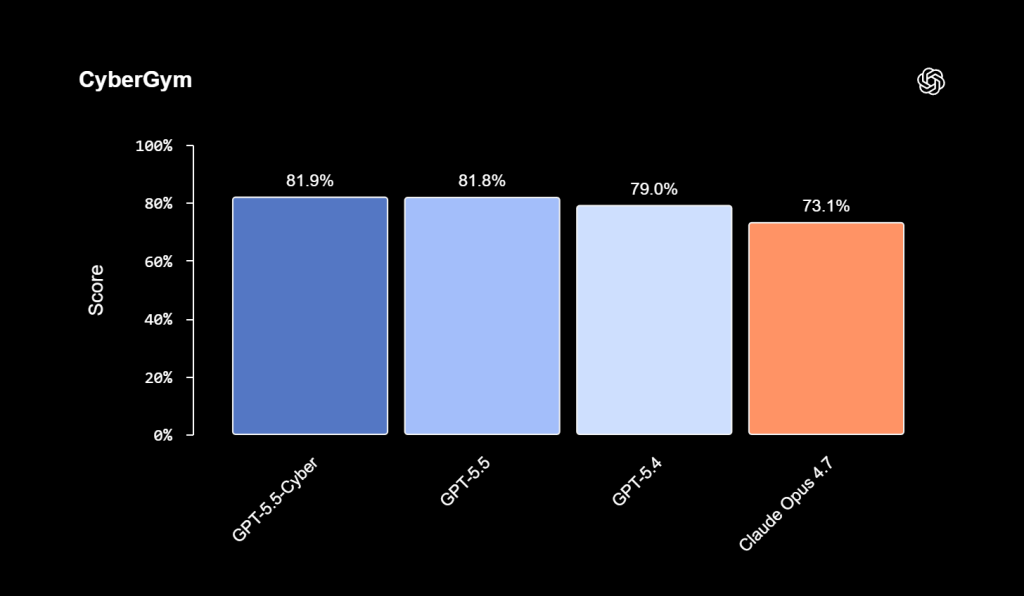

Le détail le plus important est peut-être celui qu’OpenAI glisse presque avec prudence : cette première préversion de GPT-5.5-Cyber n’est pas censée augmenter significativement les capacités cyber par rapport à GPT-5.5. Elle est surtout entraînée pour être plus permissive sur les tâches de sécurité. C’est d’abord un GPT-5.5 auquel on a desserré la cravate pour les usages « autorisés ».

Cela implique deux limites. La première est fonctionnelle : OpenAI prévient que GPT-5.5-Cyber ne surpassera pas forcément GPT-5.5 sur toutes les évaluations cyber. Pour beaucoup d’équipes, GPT-5.5 avec Trusted Access for Cyber reste le point de départ recommandé. La seconde est organisationnelle : l’accès limité, la vérification des utilisateurs, la surveillance des usages et le cadrage des cas d’emploi imposent une vraie gouvernance. Les DSI et RSSI n’achèteront pas simplement une « IA cyber ». Ils devront définir qui l’utilise, sur quels périmètres, avec quelles traces, quelles validations humaines et quelles responsabilités en cas de dérapage.

Et c’est bien là tout le paradoxe de ces nouveaux modèles « Cyber ». Plus le modèle devient utile pour les défenseurs, plus il devient dangereux hors contexte. Et rentre dans une catégorie que l’IA Act européen considère comme critique.

GPT-5.5-Cyber illustre ainsi une nouvelle ligne de fracture du marché : demain, les meilleurs modèles ne seront pas seulement segmentés par prix, vitesse ou taille de contexte. Ils seront segmentés par niveau de confiance accordé à l’utilisateur.

Daybreak : le lever du jour après Mythos

Reste qu’il manquait à OpenAI une véritable alternative au « projet Glasswing » d’Anthropic, un moyen d’embarquer tout l’écosystème numérique autour d’un vaste programme de détection et de correction de vulnérabilités sur l’existant.

C’est désormais chose faite avec Daybreak. Daybreak ne remplace pas GPT-5.5-Cyber. Il l’industrialise. OpenAI ne se contente plus de dire : « voici un modèle cyber, sous contrôle ». L’éditeur dit désormais : « voici une chaîne cyber complète, pensée pour trouver les failles plus tôt, corriger plus vite et vérifier que les correctifs tiennent ».

OpenAI présente Daybreak comme sa vision d’un logiciel « résilient by design », où la défense n’arrive plus après coup, mais s’insère dès le cycle de développement. L’offre combine les modèles OpenAI (à commencer par GPT-5.5-Cyber pour les utilisateurs validés), Codex comme harnais agentique, et les partenaires de son « security flywheel » pour intégrer revue de code sécurisée, modélisation de menace, validation de patchs, analyse des dépendances, détection et remédiation dans le flux quotidien des développeurs et des équipes sécurité.

Le nom est presque trop bien choisi. « Daybreak », c’est l’aube. Pour OpenAI, toute l’idée de son initiative est de permettre de voir le risque plus tôt et d’agir plus vite. Pour les DSI et RSSI, la promesse est plus concrète : réduire le délai entre la découverte d’une faiblesse et sa correction exploitable en production.

La mise en scène est d’ailleurs très différente de celle d’Anthropic. Mythos avait été présenté comme un modèle si puissant qu’il fallait presque le garder dans un coffre-fort. Avec Daybreak et GPT-5.5-Cyber, OpenAI adopte une tonalité moins anxiogène, plus industrielle, plus commerciale aussi. OpenAI propose même aux organisations de demander un scan de vulnérabilités ou de contacter ses équipes commerciales. On est moins dans le laboratoire secret que dans la chaîne de montage cyber.

Techniquement, Daybreak s’appuie sur Codex Security. L’outil peut bâtir un modèle de menace éditable à partir d’un dépôt logiciel, se concentrer sur les chemins d’attaque réalistes, identifier et tester des vulnérabilités dans un environnement isolé, puis proposer des correctifs à relire par des humains. L’initiative vise précisément à aider les organisations à trouver et corriger les failles avant que les attaquants ne les exploitent. Dit autrement : OpenAI ne vend pas seulement un cerveau cyber. Il propose aussi avec Daybreak (et ce que l’initiative intègre, à savoir Codex Security), le bras articulé, l’établi, les tournevis, le banc de test et le carnet d’audit.

Le goulet d’étranglement de la cybersécurité moderne n’est pas seulement la découverte des vulnérabilités. C’est leur traitement. Les organisations croulent déjà sous les alertes, les CVE, les correctifs urgents, les dépendances fragiles, les rapports de bug bounty et les faux positifs. L’IA accélère la découverte. Mais si elle n’accélère pas aussi la remédiation, elle aggrave le problème. Les outils d’IA raccourcissent le temps nécessaire pour découvrir des failles latentes, ce qui peut parallèlement mettre les processus de patch sous pression. Avec Daybreak. OpenAI veut transformer l’IA cyber en boucle continue : identifier les risques à fort impact, réduire des heures d’analyse à quelques minutes, générer et tester des patchs dans les dépôts, puis renvoyer des preuves exploitables dans les systèmes de suivi et d’audit. Dans un SOC ou une équipe AppSec, c’est beaucoup plus utile.

Pendant ce temps, ChatGPT devient plus rapide… et plus personnel

En parallèle de cette IA cyber sous haute surveillance, OpenAI pousse aussi GPT-5.5-Instant dans ChatGPT. Ce dernier remplace GPT-5.3-Instant comme modèle par défaut pour tous les utilisateurs, avec des réponses annoncées comme plus concises, plus fiables et moins bavardes. OpenAI revendique notamment 52,5 % de déclarations hallucinées en moins sur des prompts à fort enjeu, comme la médecine, le droit ou la finance.

En outre, GPT-5.5-Instant exploite mieux les anciennes conversations, les fichiers et Gmail lorsque l’utilisateur l’a connecté. Enfin, les nouvelles « memory sources » permettent de voir quels éléments ont servi à personnaliser une réponse, ce qui permet ensuite de les corriger ou de les supprimer.

____________________________

puis

puis