Annoncé au FabCon/SQLCon 2026 cette semaine, Database Hub ambitionne de centraliser la gestion de l’ensemble du parc bases de données (SQL, NoSQL, on-prem, PaaS, SaaS) directement depuis Microsoft Fabric. Avec de l’IA agentique en prime.

Pour bien mesurer la portée de l’annonce, un petit rappel s’impose. Microsoft Fabric, lancé en disponibilité générale il y a un peu plus de deux ans et demi, compte déjà plus de 31 000 clients et reste la plateforme data à la croissance la plus rapide de l’histoire de Microsoft.

Conçue comme une plateforme analytique SaaS unifiée – lakehouse, data warehouse, pipelines d’intégration, Power BI, Data Science – adossée à un data lake unique (OneLake), Fabric est devenue la pièce maîtresse de la stratégie Data & IA de Redmond.

Mais jusqu’ici, les bases de données transactionnelles restaient quelque peu en marge de cette unification. C’est précisément le trou que Database Hub vient combler.

Un plan de contrôle unifié pour tout le parc

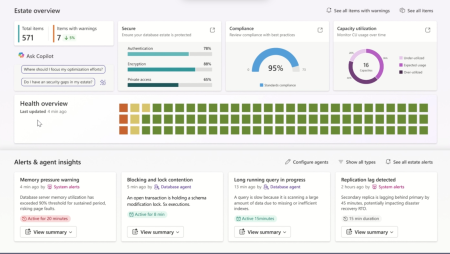

Dévoilé cette semaine, Database Hub promet un point d’entrée unique pour gérer Azure SQL Server, Azure Cosmos DB, Azure Database for PostgreSQL, Azure Database for MySQL, SQL Server on-premises (via Azure Arc) et les bases Fabric natives. En clair : un seul cockpit pour explorer, observer, gouverner et optimiser des bases relationnelles et NoSQL, qu’elles tournent en local, dans le cloud ou en SaaS. L’outil est disponible dès maintenant en accès anticipé (early access).

Shireesh Thota, Corporate Vice President Databases chez Microsoft, résume l’ambition : « les organisations gèrent aujourd’hui un patchwork de bases hétérogènes à travers des outils, des portails et des expériences de gestion fragmentés. L’idée est de refermer le fossé entre systèmes transactionnels et systèmes analytiques en les plaçant dans un même récit opérationnel au sein de Fabric. »

De l’IA agentique dans le moteur

Microsoft ne serait pas Microsoft en 2026 sans une couche d’IA par-dessus. Database Hub introduit une approche « agent-assisted, human-in-the-loop » : des agents intelligents raisonnent en continu sur les signaux émis par l’ensemble du parc pour détecter les changements, expliquer pourquoi ils comptent et guider les équipes humaines vers les actions à entreprendre.

Copilot vient bien évidemment compléter le dispositif avec des vues agrégées de santé, des analyses de tendances et des catégorisations de performance, le tout pensé pour accélérer le passage de l’insight à l’action.

De notre coté, on est assez curieux de voir comment les équipes IT vont réagir et jusqu’à quel point elles sont prêtes à faire confiance au « raisonnement » d’un agent IA pour piloter leurs bases de données de production. Certes, le modèle « human-in-the-loop » – l’humain valide, l’agent propose – est précisément conçu pour ménager le filet de sécurité attendu.

Tout le monde veut être la plateforme unifiée

L’initiative de Microsoft ne tombe pas du ciel. Databricks et Snowflake jouent exactement la même partition en sens inverse : partis de l’analytique, ils intègrent désormais des services transactionnels dans leurs plateformes. Snowflake a lancé l’an dernier un service PostgreSQL-as-a-service, tandis que Microsoft avait déjà dévoilé en 2025 une base documentaire open source construite sur un backend PostgreSQL et un service PostgreSQL distribué conçu pour rivaliser avec CockroachDB et YugabyteDB.

La convergence transactionnel/analytique est le grand mouvement tectonique du moment dans l’écosystème data. Database Hub est la réponse de Microsoft : plutôt que de multiplier les migrations, on centralise la gouvernance et l’observabilité au-dessus des bases existantes.

Microsoft annonce en parallèle des « savings plans for databases » promettant jusqu’à 35 % d’économies par rapport au tarif pay-as-you-go sur certains services. Un levier d’adoption non négligeable pour convaincre les DSI de regrouper leurs bases sous le parapluie Fabric. Avec une approche bundle/cheval de Troie très… Microsoft.

Au final, Database Hub marque un tournant important : plus que jamais, Fabric dépasse l’ambition d’une plateforme analytique pour s’affirmer en plan de contrôle de l’ensemble du patrimoine data de l’entreprise, bases transactionnelles comprises. C’est un pari ambitieux mais opportun, car l’IA d’entreprise oblige les organisations à repenser la valeur de chaque copie de données, de chaque frontière de schéma et de chaque transfert opérationnel. La promesse est séduisante. Les premiers retours d’expérience en diront long sur l’alignement entre la théorie et la pratique.

____________________________

puis

puis