Quelques semaines après l’arrivée de Claude 3.7 Sonnet, premier modèle IA hybride mêlant LLM classique et raisonnement d’Anthropic, et devançant l’arrivée très attendue de GPT-5 (le premier modèle GPT hybride d’OpenAI), Google officialise son premier modèle hybride et premier modèle de la famille « Gemini 2.5 ».

Depuis l’arrivée des modèles OpenAI o1, puis o3, l’humanité a découvert que les IA génératives pouvaient prendre le temps de la réflexion avant de répondre et donc de raisonner ! Depuis, les différents acteurs de l’IA cherchent non seulement à rattraper les capacités de raisonnement d’OpenAI o3 mais aussi à simplifier l’expérience des utilisateurs en leur évitant d’avoir à choisir entre des modèles d’IA classiques et des modèles d’IA à raisonnement.

C’est ainsi qu’il y a quelques semaines, OpenAI a annoncé sa volonté de fusionner ses modèles de type « GPT » et de type « o1/o3 » pour donner naissance à GPT-5 et qu’Anthropic a lancé son excellent et surprenant « Claude 3.7 Sonnet » doté d’un mode de raisonnement « normal » ou « étendu » selon vos besoins.

Histoire de ne pas laisser ses concurrents occuper le terrain, Google avait initié en début d’année un modèle expérimental dénommé « Gemini 2.0 Flash Thinking Experimental ». Mais l’éditeur poursuit ses efforts d’innovation et annonce déjà non seulement la sortie prochaine d’une nouvelle famille complète de modèles d’IA conçus pour « réfléchir » avant de répondre aux questions mais aussi la disponibilité immédiate du plus évolué modèle de cette nouvelle famille « Gemini 2.5 Pro » !.

Un modèle « pensant » à la pointe de la technologie

« Gemini 2.5 est un modèle pensant, capable de raisonner à travers ses pensées avant de répondre, ce qui se traduit par des performances améliorées et une précision accrue« , explique Koray Kavukcuoglu, CTO of Google DeepMind dans un billet de blog. Cette approche permet au modèle d’analyser les informations, de tirer des conclusions logiques et d’incorporer contexte et nuances dans ses décisions à l’aide d’un processus connu sous le nom de « Chain of Thought ».

« Pendant longtemps, nous avons exploré des moyens de rendre l’IA plus intelligente et plus capable de raisonner grâce à des techniques comme l’apprentissage par renforcement et les invites en chaîne de pensée. Dans cette continuité, nous avons récemment présenté notre premier modèle à raisonnement, Gemini 2.0 Flash Thinking » explique ainsi Koray Kavukcuoglu. « Maintenant, avec Gemini 2.5, nous avons atteint un nouveau niveau de performance en combinant un modèle de base considérablement amélioré avec un post-entraînement perfectionné. À l’avenir, nous intégrons ces capacités de réflexion directement dans tous nos modèles, afin qu’ils puissent gérer des problèmes plus complexes et soutenir des agents encore plus performants et conscients du contexte.«

Le premier modèle de cette nouvelle génération, Gemini 2.5 Pro Experimental, est déjà disponible sur Google AI Studio et dans l’application Gemini pour les utilisateurs de Gemini Advanced, y compris en Europe ! Il sera prochainement accessible sur Vertex AI, la plateforme cloud de Google destinée aux entreprises et à la création d’applications IA.

Des performances qui dépassent les références du secteur

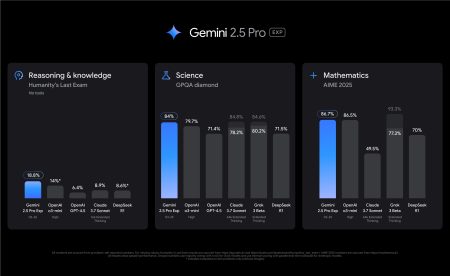

Google affirme que Gemini 2.5 Pro se classe en tête du classement LMArena – qui mesure les préférences humaines – avec une marge significative. Le modèle présente également de solides capacités de raisonnement et de codage, dominant sur les benchmarks courants dans ces domaines.

« Gemini 2.5 Pro est à la pointe de la technologie dans toute une série de tests nécessitant un raisonnement avancé« , affirme le CTO de Google Deepming. Sans user de techniques d’optimisation qui font enfler les coûts, le modèle se démarque dans les benchmarks mathématiques et scientifiques comme GPQA et AIME 2025.

Il obtient également un score de 18,8% sur « Humanity’s Last Exam », un ensemble de données conçu par des centaines d’experts pour capturer la frontière humaine de la connaissance et du raisonnement.

Des capacités de codage avancées

« Nous nous sommes concentrés sur les performances de codage, et avec Gemini 2.5, nous avons réalisé un grand bond en avant par rapport à la version 2.0« , affirme également Google. Selon l’éditeur, son nouveau modèle excelle dans la création d’applications web visuellement attrayantes et d’applications de code agentique, ainsi que dans la transformation et l’édition de code.

Sur SWE-Bench Verified, la référence du secteur pour les évaluations de code agentique, Gemini 2.5 Pro obtient un score de 63,8% avec une configuration d’agent personnalisée.

Une fenêtre de contexte étendue

Gemini 2.5 s’appuie sur les points forts des modèles Gemini précédents : multimodalité native et large fenêtre de contexte. Il est livré avec une fenêtre de contexte d’un million de tokens (deux millions à venir prochainement), permettant de comprendre de vastes ensembles de données et de traiter des problèmes complexes provenant de différentes sources d’information : texte, audio, images, vidéo et même des référentiels de code entiers.

Google n’a pas encore communiqué de tarification pour l’API Gemini 2.5 Pro, mais promet des informations à ce sujet dans les semaines à venir.

Dans un contexte où les grands acteurs technologiques comme OpenAI, Anthropic, DeepSeek et xAI développent tous leurs propres modèles de raisonnement, cette annonce vient repositionner Google dans la course à l’innovation dans le domaine de l’IA générative, avec une nouvelle famille 2.5 de modèles encore plus adaptés aux défis IA des entreprises et à la création d’agents autonomes capables d’effectuer des tâches complexes avec une intervention humaine minimale.

puis

puis