2024 a été l’année des SLM, les petits modèles de langage. Et pour clôturer cette année SLM en beauté, IBM présente Granite 3.1, ses nouveaux petits modèles open source pour l’entreprise, aux performances étonnantes qui se rapprochent de celles de grands modèles propriétaires comme ceux d’OpenAI, Google ou Anthropic.

IBM poursuit sa lancée dans l’IA d’entreprise « ouverte » avec la sortie de Granite 3.1, dernière itération de la famille Granite. La précédente itération « 3.0 » avait été lancée en Octobre dernier.

Cette nouvelle version améliore nettement les performances, étend la taille du contexte, introduit des mécanismes de détection des “hallucinations” dans les appels de fonctions et propose de nouveaux modèles d’embeddings multilingues.

Des performances en hausse

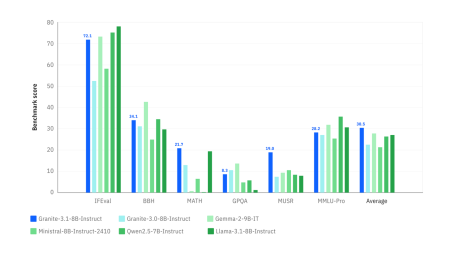

Avec ses 8 milliards de paramètres, le modèle phare Granite 3.1 8B Instruct appartient à la catégorie des « petits » modèles que l’on peut exécuter en local. Il surpasse la plupart des autres LLM open source de sa catégorie (8 milliards de paramètres) si on s’appuie sur les évaluations comparatives réalisées via la plateforme Hugging Face OpenLLM Leaderboard.

Ces avancées s’expliquent, entre autres, par :

– Une meilleure compréhension des instructions complexes (évaluée via le jeu de données IFEval).

– Une capacité de raisonnement améliorée sur de longs textes (testée avec Multi-step Soft Reasoning, MuSR).

– Une fenêtre contextuelle de 128 000 tokens (alignée sur celle récemment introduite avec LLama 3.3).

Selon IBM, grâce à ces optimisations, Granite 3.1 se positionne comme une nouvelle référence pour les cas d’usage critiques en entreprise, y compris la génération de code, la traduction et la création d’agents décisionnels.

Des compléments centrés sur les cas d’usage des entreprises

Parallèlement aux modèles Granite 3.1, IBM annonce aussi son nouveau modèle de contrôle des IA « Granite Guardian 3.1 » et ses modèles d’embeddings « Granite-Embedding » optimisés pour le RAG, la recherche sémantique et la vectorisation des documents textuels.

Granite Guardian 3.1 (en versions 8B et 2B) intègre un système de détection des “hallucinations” dans les workflows “agentiques” où un modèle appelle des fonctions externes (par exemple pour interroger une base de données ou effectuer un calcul).

Le modèle surveille en temps réel chaque appel de fonction pour s’assurer que les données renvoyées ne sont pas fabriquées ou mal interprétées. Il offre ainsi un niveau supplémentaire d’audit et de fiabilité, essentiel pour les applications d’entreprise où chaque opération doit être vérifiable et traçable.

En plus de ses modèles génératifs, IBM propose désormais des modèles d’embeddings optimisés pour la recherche sémantique, la vectorisation de documents et l’augmentation de la pertinence en retrieval augmented generation (RAG). Quatre versions sont disponibles : Granite-Embedding-30M-English, Granite-Embedding-125M-English, Granite-Embedding-107M-Multilingual, Granite-Embedding-278M-Multilingual.

Les deux derniers sont les plus intéressants et prennent en charge 12 langues (anglais, allemand, espagnol, français, japonais, portugais, arabe, tchèque, italien, coréen, néerlandais et chinois). IBM a validé l’éligibilité commerciale des données d’entraînement et fournit une indemnisation illimitée vis-à-vis des réclamations tierces liées à la propriété intellectuelle.

Tous les modèles Granite 3.1, y compris Granite Guardian et les Granite Embeddings, sont distribués sous licence Apache 2.0, en adéquation avec l’engagement historique d’IBM pour l’open source. IBM ne précise pas si ses modèles sont réellement conformes à la définition des « IA open source » de l’OSI, mais cela semble effectivement être le cas.

Les modèles Granite 3.1 sont disponibles dès aujourd’hui sur la plateforme IBM watsonx.ai et auprès de partenaires tels que Docker, Hugging Face, LM Studio, Ollama et Replicate. Ils seront également intégrés à la plateforme NIM de NVidia début 2025.

puis

puis