On s’y attendait, Google a focalisé sa conférence Google I/O 2023 sur les intelligences génératives et multiplie les outils et services IA à destination des utilisateurs mais aussi des créateurs et des développeurs pour des Apps plus utiles et plus intelligentes.

De l’IA en veux-tu, en voilà, même si tu n’en veux pas… « Comme vous l’avez probablement entendu, l’IA connaît une année très active. Nous avons donc beaucoup à dire à ce sujet » annonce d’emblée Sundar Pichai, CEO de Google, avant de préciser que son entreprise réinvente aujourd’hui tous ses produits à la sauce IA.

Durant deux heures, l’éditeur a levé le voile sur les multiples fonctionnalités et services IA qu’il prépare pour sa suite Workspace, pour son moteur de recherche, pour ses applications Android et pour son cloud.

Nous vous proposons ici de retrouver l’essentiel des IA présentées lors du Keynote d’ouverture de Google I/O 2023 qui s’est tenu hier soir, à l’exception de l’intelligence conversationnelle BARD à qui nous avons réservé un article séparé à retrouver ici : Google I/O 2023 : BARD débarque dans 180 pays… sauf la France.

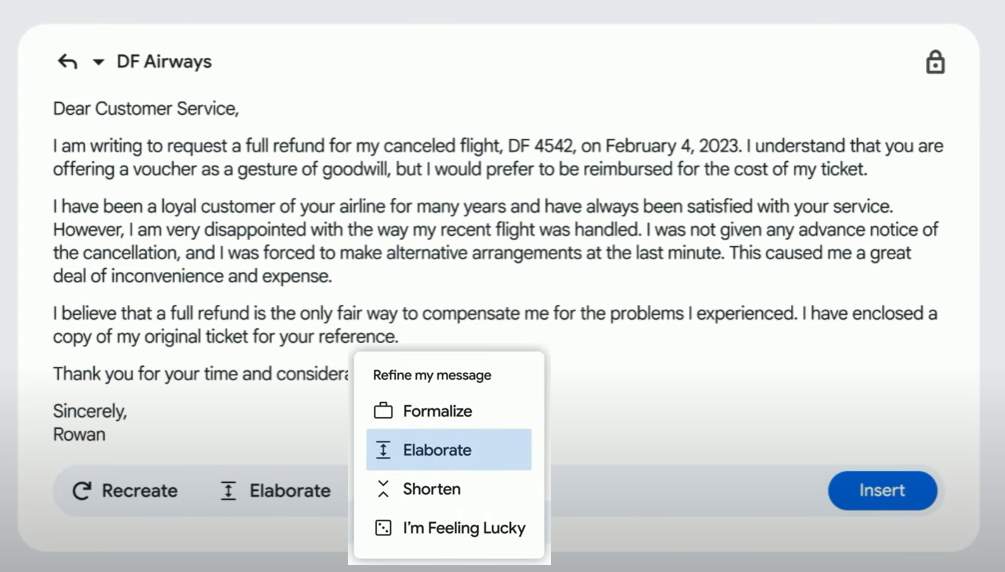

GMAIL Help Me Write

GMAIL Help Me Write

Google va prochainement introduire une IA générative au cœur de Gmail dénommée « Help Me Write ». Quand vous répondez à un message notamment (mais également en créant un message), une nouvelle icône permet de générer automatiquement une proposition de réponse. Typiquement, Google a montré comment l’IA pouvait vous aider à rédiger un email pour réclamer un remboursement de votre billet d’avion après avoir reçu un email de la compagnie aérienne vous signifiant l’annulation de votre vol.

Immersive View for routes

Aujourd’hui grâce à l’IA et sa capacité à combiner données géographiques, images satellites, photos exposées par les utilisateurs, Google est en mesure de représenter en 3D la quasi-intégralité d’une ville et de proposer un guidage avec une vue bien plus réaliste et immersive. Tout en enrichissant cette vue de milliers de données utiles (indice de pollution, points d’intérêts, météo, trafic, etc.) façon réalité augmentée.

Aujourd’hui grâce à l’IA et sa capacité à combiner données géographiques, images satellites, photos exposées par les utilisateurs, Google est en mesure de représenter en 3D la quasi-intégralité d’une ville et de proposer un guidage avec une vue bien plus réaliste et immersive. Tout en enrichissant cette vue de milliers de données utiles (indice de pollution, points d’intérêts, météo, trafic, etc.) façon réalité augmentée.

Cette représentation 3D fidèle, dénommée Immersive View, sera intégrée à Google Maps dès cet été. Mais seule une quinzaine de villes bénéficieront d’un tel avantage dont Londres, New York, Tokyo et San Francisco.

Il reste encore beaucoup de chemins pour offrir une telle vue généralisée à toutes les villes et toutes les routes de campagne.

Photo Magic Editor

L’application Photo de Google disposait déjà d’une fonction Magic Eraser pour éliminer le fond d’une photo ou au contraire un objet disgracieux d’une photo (comme un pylône électrique ou une poubelle).

L’application Photo de Google disposait déjà d’une fonction Magic Eraser pour éliminer le fond d’une photo ou au contraire un objet disgracieux d’une photo (comme un pylône électrique ou une poubelle).

Grâce aux nouvelles IA génératives, Google va plus loin. D’ici la fin de l’année, l’éditeur va intégrer à Photo une fonction Magic Editor. En un clic on peut sélectionner un personnage par exemple puis le recentrer ou le déplacer, l’IA se chargeant de reconstituer les éléments qui manquent. Typiquement, dans l’exemple présenté, l’utilisateur veut recentrer un enfant tenant des ballons. Mais le cadrage fait que seule une moitié des ballons est présente sur la photo. Magic Editor permet de sélectionner l’enfant et ses ballons, de les recentrer sur le décor, l’IA se chargeant de reconstruire le décor mais aussi de recréer la partie manquante de la photo et reconstituer les ballons non photographiés.

Search Generative Experience

On le sait depuis plusieurs mois, Google compte aussi réinventer son moteur de recherche grâce à l’IA générative. Empruntant une route similaire à celle suivie par You.com et par Bing, en intégrant une intelligence conversationnelle au sein du moteur.

La nouvelle expérience utilisateur de Search, dénommée SGE (Search Generative Experience) n’évolue pas de prime abord. Mais lorsque l’on pose une question, Google Search affiche en haut de la page habituelle (avec ses liens sponsorisés, ses occurrences de réponses et images) une section comportant une réponse multimodale (mixant textes et images) synthétisant les informations trouvées à travers le Web. Cette section évoque furieusement les Knowledge Cards et Stories produites par l’IA du nouveau Bing.

L’IA propose ensuite différents sujets connexes (sous forme de questions) ainsi qu’un bouton « Follow Up ». Il suffit de cliquer sur l’un d’eux pour automatiquement démarrer une session conversationnelle très similaire à l’expérience « Conversation » ou YouChat que l’on trouve dans Bing ou You.com. Mais à la différence de ces derniers, cette nouvelle expérience de recherche est encore en preview fermée. Il faut s’inscrire à une liste d’attente qui n’est par ailleurs pour l’instant ouverte qu’aux internautes américains.

Google a montré comment ce mode conversationnel permet par exemple de demander à Search de réaliser des comparatifs de produits ou d’offres, de créer un résumé d’une page, etc.

Duet AI, le Copilot façon Google

Google avait déjà dévoilé en Mars comment il envisageait d’introduire des IA génératives au cœur de sa suite Google Workspace. Ces IA ont désormais un nom : « Duet AI for Workspace».

« Workspace a été conçu pour vous permettre de collaborer en temps réel avec d’autres personnes. Désormais, vous pouvez collaborer en temps réel avec l’IA », explique Aparna Pappu, VP Workspace chez Google.

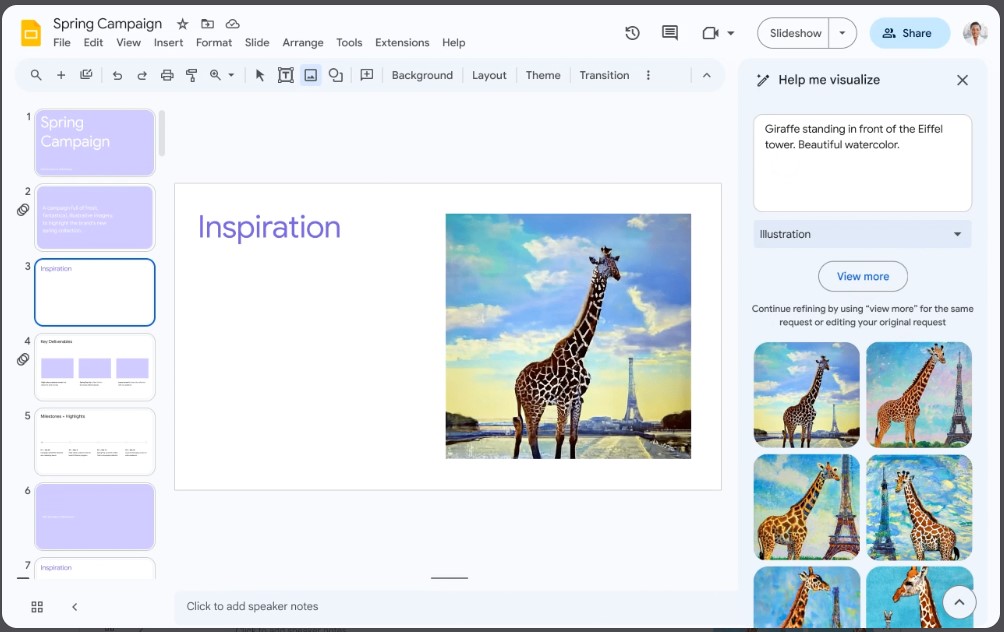

Dans Gmail et Docs, Duet AI vous aide à générer des plans, des réponses, des textes, des résumés. Dans Google Slides, Duet AI génère des images pour vous aider à illustrer vos présentations sans passer des heures à chercher des images libres de droits sur la toile. Dans Google Sheets, Duet AI permet d’automatiser certaines actions répétitives ou pour importer plus facilement des données du Web dans un tableau.

Duet AI for Google Cloud

De même que Microsoft décline « Copilot » à toutes les sauces, Google fait de même avec Duet AI. Google Cloud s’enrichit ainsi d’une interface conversationnelle qui permet aux développeurs d’interroger l’IA pour se guider dans l’univers Google Cloud, acquérir des bonnes pratiques et surtout générer ou déboguer du code.

Duet AI s’implémente également dans AppSheet, l’outil de développement No-Code de Google. Il devient ainsi possible de générer des applications complètes simplement en exprimant son besoin en langage naturel.

Ces fonctionnalités sont en preview auprès d’un petit groupe de testeurs sur invitation Google.

De nouveaux modèles pour Vertex AI

Google Cloud avait récemment annoncé l’introduction de modèles LLM dans sa plateforme de démocratisation de l’IA : Vertex AI.

À Google I/O, Google Cloud a annoncé trois nouveaux modèles pour enrichir l’univers de Vertex AI :

– Imagen, pour la génération d’images ;

– Codey, pour accélérer la création d’applications en aidant à la génération de code ;

– Chirp, un modèle vocal universel qui permet du « Speech to Text », autrement dit de la reconnaissance vocale, dans plus de 100 langues.

Gemini, le futur de PaLM

À Google I/O, Sundar Pichai s’est beaucoup étendu sur l’entrée en production du moteur LLM « PaLM 2 » qui anime notamment les dernières itérations de BARD. Mais il n’y aura probablement pas de PaLM 3.

Car l’éditeur planche déjà avec sa filiale DeepMind sur une nouvelle génération de modèles plus multimodaux et plus évolués que les LLM actuels. Il s’agit de Gemini. « Nous travaillons déjà sur Gemini, notre prochain modèle créé dès le départ pour être multimodal, très efficace en matière d’intégration d’outils et d’API, et conçu pour permettre de futures innovations, telles que la mémoire et la planification. Gemini est encore en cours de formation, mais il présente déjà des capacités multimodales jamais vues dans les modèles précédents. Une fois affiné et rigoureusement testé pour la sécurité, Gemini sera disponible en différentes tailles et capacités, tout comme PaLM 2, afin de s’assurer qu’il peut être déployé dans différents produits, applications et appareils pour le bénéfice de tous » confirme Google.

Gemini est directement entraîné par un mixte de sources textuelles, photographiques, vidéos, et audios.

Project Tailwind

Pour l’instant plus un prototype qu’un produit, Project Tailwind se présente comme un bloc-notes intelligent. Vous sélectionnez sous Google Drive un ensemble de documents. TaiLwind va générer à partir de ces derniers un modèle IA personnalisé que vous pourrez ensuite interroger en langage naturel pour comprendre le sujet, acquérir ou développer une expertise, etc. L’idée actuelle est d’en faire un outil pour étudiants ou scientifiques ayant besoin d’explorer interactivement un sujet de recherche.

puis

puis