Google a beau avoir un important centre de R&D en IA en France, l’Hexagone ne semble pas faire partie de ses priorités. À l’occasion de Google I/O 2023, l’IA conversationnelle de Google, Bard, jusqu’ici uniquement anglophone, s’est formée aux langues japonaises et coréennes et s’est ouverte à 180 pays… mais n’est toujours pas accessible en France !

Chaque année l’évènement Google I/O, très orienté développeurs, est l’occasion de faire le point sur l’écosystème Android et la vision de Google en matière de services. L’édition 2023 s’est ouverte hier. On savait que l’IA y tiendrait une place importante. Et on a été servi ! Sur les 3 heures de keynotes, plus de deux heures ont été dédiées à l’IA… L’univers Android a dû se contenter des restes… Nous y reviendrons dans un autre article dans la journée.

Pour ce qui est de l’IA, toutes les attentions étaient focalisées sur BARD, l’IA conversationnelle destinée à concurrencer à la fois ChatGPT et Bing Chat. Présentée en février, lancée en version restreinte aux US en mars, enrichie de capacité de codage en avril, l’IA BARD était bien la star du show.

Pour l’occasion, Google a annoncé plusieurs améliorations, certaines disponibles dès aujourd’hui, d’autres dans les semaines à venir.

Bard boude la France…

La principale information de la soirée, c’est que Google commence à ouvrir plus grandes les portes d’accès à son IA. L’éditeur annonce la suppression de la liste d’attente et l’ouverture de l’accès depuis 180 pays. Certes, pour l’instant, les échanges se limitent à l’anglais, le japonais et le Coréen. Mais 40 nouveaux langages seront « prochainement » ajoutés assurent Google.

La principale information de la soirée, c’est que Google commence à ouvrir plus grandes les portes d’accès à son IA. L’éditeur annonce la suppression de la liste d’attente et l’ouverture de l’accès depuis 180 pays. Certes, pour l’instant, les échanges se limitent à l’anglais, le japonais et le Coréen. Mais 40 nouveaux langages seront « prochainement » ajoutés assurent Google.

Seul bémol – et de taille – la France reste l’un des rares pays dans le monde à ne pouvoir essayer BARD, même en anglais. Surprenant quand on sait que Google dispose d’un centre de recherche en IA dans notre pays et y avait même organisé un évènement international en Février pour justement lancer sa stratégie de conquête IA.

Il est probable que Google ait préféré attendre le support de la langue française dans BARD (support confirmé par Google dans les 40 langues prochainement supportées) avant d’officialiser l’accès à son IA conversationnelle depuis notre pays.

Un nouveau modèle LLM pour tenir la dragée haute à GPT-4

Mais Google a surtout profité de sa conférence pour offrir des démos et aperçus des innovations à venir autour de BARD.

Ainsi, l’éditeur annonce que son IA va de nouveau connaître une amélioration majeure de ses capacités en basculant sur le nouveau modèle PaLM 2. Pour rappel, Bard a d’abord été lancé en appui sur un modèle LLM dénommé LaMBDA issu des labos de Google et Deepmind. En avril, Bard connaissait sa première évolution majeure avec le passage à un modèle LLM plus élaboré dénommé PaLM (Pathways Language Model).

Si Google – empruntant désormais la même attitude qu’OpenAI – se refuse à livrer des détails sur l’ampleur de ce modèle et le nombre de paramètres, l’éditeur précise quand même que ce LLM « next gen » a été optimisé pour ses accélérateurs TPU v4 (Tensor Processing Unit) et qu’il anime désormais plus de 25 animations IA de Google (dont BARD).

Par ailleurs, Google sait désormais « spécialiser » PaLM 2 à des fins spécifiques. Typiquement les modèles Sec-PaLM (au cœur de sa solution de cybersécurité Cloud Security Workbench) ou Med-PaLM (dédié au secteur de la santé) dérivent directement de PaLM 2.

Accélération sur les innovations

Et Google compte rapidement exploiter pleinement le potentiel de ce nouveau modèle IA à travers BARD.

A

Autre nouveauté phare, l’IA BARD va – elle aussi – supporter des plug-ins. C’est la nouvelle tendance du moment : permettre aux IA conversationnelles d’agir en s’interfaçant avec des API et d’autres IA grâce à des extensions. L’idée a été introduite en février dernier sur ChatGPT par OpenAI. Microsoft a confirmé la semaine dernière l’arrivée prochaine des « Bing Actions » dans Bing Chat.

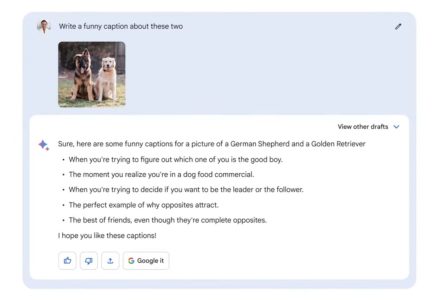

Désormais, BARD va, lui aussi, prochainement supporter des intégrations à des services tiers. Typiquement, Google a montré comment un partenariat avec Adobe permettra à BARD de profiter des fonctionnalités de génération d’images de Firefly, la nouvelle IA générative d’Adobe !

Enfin, BARD va prochainement bénéficier d’améliorations ergonomiques telles que l’apparition d’un mode sombre (apparemment c’est encore un truc qui émerveille vu le nombre de « Whaouu » venant de l’assemblée lors de la démo), mais aussi l’export instantané des réponses générées par BARD vers Gmail et Google Docs.

Pour conclure, Google continue d’accélérer pour rattraper son retard sur ChatGPT et Bing Chat. Reste à voir à l’usage si BARD se montre plus pertinent ou pas, voire tout simplement différent. Ce que pour l’instant, nous, français, sommes bien incapables de vérifier. En attendant l’arrivée de « French BARD »…

puis

puis