Voilà qui risque plus d’inquiéter les entreprises que de leur rendre service : La nouvelle IA VALL-E de Microsoft peut imiter n’importe quelle voix après moins de 3 secondes d’apprentissage.

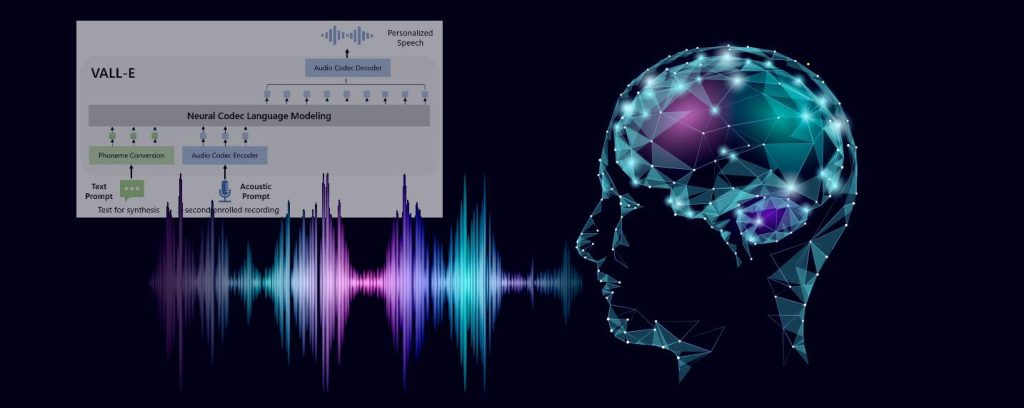

Microsoft a dévoilé cette semaine un nouveau modèle IA linguistique de type TTS (Text-To-Speach) dénommé VALL-E capable de reproduire les émotions et intonations humaines avec beaucoup de réalisme.

Mais cette IA va un peu plus loin que les intelligences de lecture de texte actuelles. Elle peut en effet copier n’importe quelle voix plutôt que d’imposer des voix pré-définies.

Plus concrètement, il lui suffit de 3 secondes pour copier votre tonalité et votre façon de parler. Elle peut alors lire n’importe quel texte avec votre voix.

Outre sa capacité à reproduire n’importe quelle voix, cette IA est capable de moduler son discours vocal pour retranscrire des humeurs. Dans les exemples présentés, l’IA peut dicter « Nous devons réduire le nombre de sacs en plastique » en y exprimant au choix de la colère, du dégoût, de l’amusement, de la somnolence, etc.

L’IA reste pour le moment limitée à l’anglais puisqu’elle a été entraînée avec 60 000 heures de données vocales dans cette langue.

Dans la pratique, cette IA peut être utilisée pour ajouter des voix off sur des images ou des commentaires à des slides. Mais elle peut aussi être utilisée à des fins malveillantes par des cybercriminels pour faire du chantage ou de l’usurpation d’identité par téléphones. En septembre 2019 déjà, un cybercriminel avait utilisé de telles IA d’imitation vocale pour dérober 200.000 euros à une entreprise en se faisant passer pour son directeur financier.

Comme l’explique les chercheurs derrière l’expérience VALL-E, « puisque VALL-E peut synthétiser la parole en conservant l’identité du locuteur, elle peut comporter des risques potentiels de mauvaise utilisation, comme l’usurpation de l’identification de la voix ou l’usurpation de l’identité d’un locuteur spécifique. Nous avons mené les expériences en supposant que l’utilisateur accepte d’être le locuteur cible dans la synthèse vocale. Lorsque le modèle est généralisé à des locuteurs invisibles dans le monde réel, il devrait inclure un protocole pour s’assurer que le locuteur approuve l’utilisation de sa voix et d’un modèle de détection de la parole synthétisée ».

Voilà qui explique pourquoi VALL-E n’est encore qu’un projet de recherche et non un nouveau service Azure accessible à tous.

puis

puis